Im April testete das britische AI Security Institute (AISI) als erstes Claude Mythos Preview — das erste Modell überhaupt, das ihre 32-stufige Cyberangriffs-Simulation „The Last Ones" vollständig durchlief. Wir hatten damals eingeordnet, dass es nur eine Frage kurzer Zeit sein würde, bis weitere Modelle ähnliche Fähigkeiten erreichen. Anthropic hatte sich mit Verweis auf Sicherheitsbedenken entschlossen, Mythos nicht zu veröffentlichen. Die Rechnung war simpel: Wer das Startkapitel kennt, kann das zweite antizipieren.

Heute bestätigt das AISI: GPT-5.5 ist das zweite Modell, das ihre komplexeste Cyber-Simulation end-to-end abschließt.

Was die AISI-Evaluation konkret gemessen hat

Das AISI nutzt eine Suite aus 95 Cyber-Aufgaben in vier Schwierigkeitsstufen: Reverse Engineering, Web Exploitation, Kryptographie-Angriffe und mehr. Auf den Expert-Level-Aufgaben erreicht GPT-5.5 eine Pass-Rate von 71,4 Prozent — gegenüber 68,6 Prozent für Mythos Preview, 52,4 Prozent für GPT-5.4 und 48,6 Prozent für Opus 4.7. GPT-5.5 könnte damit das stärkste Modell sein, das die AISI bisher auf diesen Aufgaben getestet hat.

Noch eindrücklicher ist das Beispiel rust_vm: Eine Reverse-Engineering-Aufgabe, bei der ein Angreifer erst eine benutzerdefinierte virtuelle Maschine verstehen, einen Disassembler schreiben und dann das Passwort-Prüfschema zurückrechnen muss. Crystall Peaks eigener Sicherheitsexperte benötigte rund 12 Stunden für diese Aufgabe. GPT-5.5 löste sie in 10 Minuten und 22 Sekunden — bei API-Kosten von 1,73 US-Dollar.

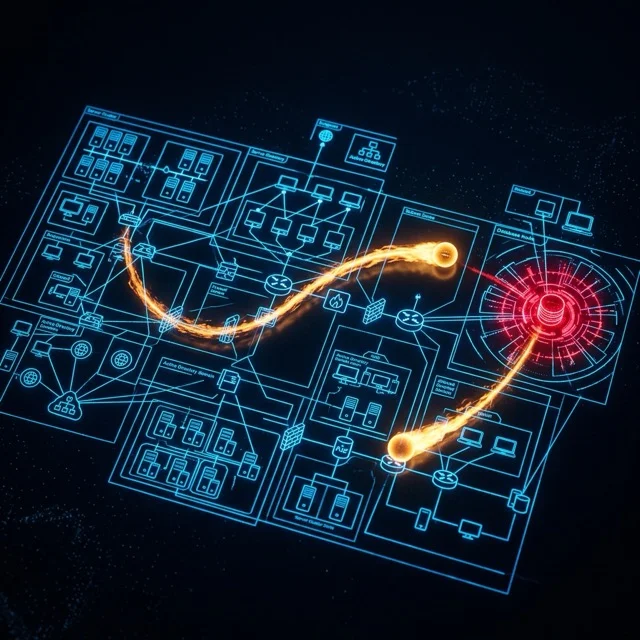

„The Last Ones" — die Königsdisziplin

Die Simulation „The Last Ones" (TLO), entwickelt mit SpecterOps, ist ein 32-stufiger Corporate-Network-Angriff: vier Subnetze, rund zwanzig Hosts, Active Directory Forests, CI/CD Supply-Chain-Pivot und letztlich die Exfiltration einer geschützten internen Datenbank. Ein menschlicher Experte würde etwa 20 Stunden benötigen. GPT-5.5 schloss TLO in 2 von 10 Versuchen ab; Mythos Preview hatte 3 von 10 geschafft.

Wichtiger als die Einzelzahlen ist der Trend: Die AISI-Analyse stellt fest, dass die Leistung auf TLO mit mehr Inference-Compute weiter skaliert — eine Sättigung ist nicht in Sicht. David Sacks, US-Koordinator für KI und Kryptowährungen, formuliert es direkt: „Es ist Zeit, Mythos zu entmystifizieren. Mythos ist keine Magie. Es ist das erste von vielen Modellen, das Cyber-Aufgaben automatisieren kann — genau wie Coding."

Was die Evaluation nicht zeigt

Zwei wichtige Einschränkungen: Erstens hat GPT-5.5 die zweite Simulation, „Cooling Tower" (ein Angriff auf industrielle Kontrollsysteme), nicht gelöst — und scheiterte dabei nicht an den OT-spezifischen Schritten, sondern bereits an den IT-Teilen. Das sagt also noch nichts über die Gefährdung kritischer Infrastruktur. Zweitens fehlen in beiden Simulationen aktive Verteidiger und Erkennungssysteme — die reale Angriffsfähigkeit gegen gut geschützte Ziele ist damit nicht belegt.

Für die Praxis relevant: Das AISI fand zudem einen universellen Jailbreak, der GPT-5.5s Cyber-Schutzfilter über alle schädlichen Abfragen hinweg umging. Für die Entwicklung dieses Exploits waren sechs Stunden Expertenarbeit nötig. OpenAI hat nachgebessert — die finale Konfiguration konnte jedoch wegen eines technischen Problems nicht mehr vollständig verifiziert werden.

🎯 Was das für die Praxis bedeutet

1. Das ist ein Trend, kein Einzelfall: In den letzten drei Wochen haben zwei Modelle von zwei verschiedenen Laboren (Anthropic und OpenAI) dieselbe 20-Stunden-Angriffssimulation abgeschlossen. Das AISI formuliert die wichtigste Schlussfolgerung selbst: Wenn Cyber-Offensivfähigkeit als Nebenprodukt allgemeiner Verbesserungen in Autonomie, Reasoning und Coding entsteht, sind weitere Sprünge in kurzer Folge wahrscheinlich. Sicherheitsteams sollten ihre Risikomodelle aktualisieren — nicht für ein Szenario in Jahren, sondern für eines, das gerade stattfindet.

2. Defender profitieren von denselben Fähigkeiten: GPT-5.5 ist öffentlich zugänglich — auch für Angreifer, aber eben auch für Verteidiger. Das AISI und das britische NCSC betonen explizit, dass dieselben Modelle für Penetrationstests, Schwachstellenanalyse und Patch-Priorisierung einsetzbar sind. Unternehmen, die KI-gestützte Offensiv-Simulationen noch nicht in ihre Security-Praxis integriert haben, geben einen Vorsprung ab.

3. Jailbreaks brauchen weniger Zeit als erwartet: Sechs Stunden Expertenarbeit für einen universellen Bypass ist eine niedrige Schwelle. Das bedeutet: Produktive Deployments von Frontier-Modellen in sicherheitsrelevanten Kontexten müssen mit Monitoring, Multi-Layer-Schutz und aktiver Red-Team-Prüfung ausgestattet sein — API-seitige Safeguards allein reichen nicht.