Guter Code ist das Gegenteil eines guten Skills. Was Softwareentwickler in Jahren verinnerlichen - explizit schreiben, einfach halten, Spezialfälle vermeiden - wird beim Bau von KI-Agenten-Fähigkeiten zur Falle. Perplexity hat jetzt den internen Leitfaden veröffentlicht, mit dem das Agents-Team seine Agent Skills entwickelt und pflegt. Das Dokument offenbart, wie weit sich die Disziplin vom klassischen Software Engineering entfernt hat.

Skills statt Code: Eine neue Disziplin

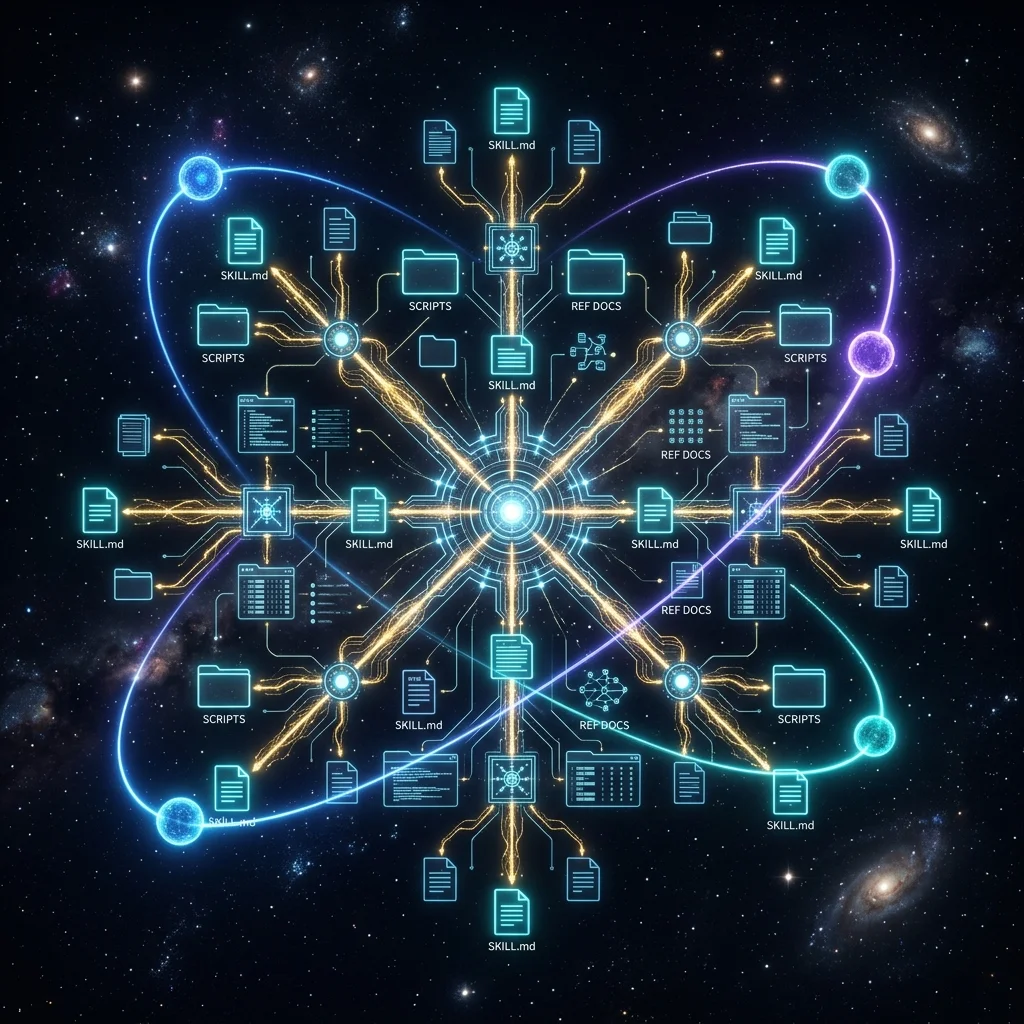

Ein Skill bei Perplexity ist kein Prompt und keine Konfigurationsdatei. Es ist ein ganzes Verzeichnis mit Frontmatter-Metadaten, Skripten, Referenzdokumenten und Templates - vergleichbar mit einem kleinen Softwarepaket, das der Agent bei Bedarf in seine Sandbox lädt. Perplexity Computer orchestriert damit heute Dutzende spezialisierter Fähigkeiten quer durch Finanzen, Recht, Gesundheit und Steuern.

Die Herausforderung liegt nicht im Schreiben, sondern im Weglassen. Jeder Skill kostet Kontext - und Kontext ist bei heutigen Sprachmodellen die härteste Währung. Perplexity unterscheidet drei Kostenstufen: Der Index (Name plus Beschreibung, rund 100 Token pro Skill) wird in jeder Session für jeden Nutzer bezahlt. Der geladene Skill-Body sollte maximal 5.000 Token umfassen. Erst die Laufzeit-Dateien - Skripte, Nachschlagewerke, Templates - dürfen unbegrenzt wachsen, weil der Agent sie nur bei tatsächlichem Bedarf liest.

Die Zen-of-Python-Inversion

Das Agents-Team hat einen provokanten Vergleich gezogen: Mindestens die Hälfte der 20 Weisheiten aus PEP 20 (dem "Zen of Python") sind beim Skill-Design schlicht falsch. "Simple is better than complex"? Ein Skill ist ein Ordner, keine Datei - Komplexität ist hier das Feature. "Explicit is better than implicit"? Skill-Aktivierung funktioniert über implizites Pattern Matching. "If the implementation is easy to explain, it may be a good idea"? Wenn es einfach zu erklären ist, kennt das Modell es bereits aus seinen Trainingsdaten. Dann kann man den Skill löschen.

Das klingt kontraintuitiv, hat aber einen harten praktischen Grund: Jeder Satz in einem Skill muss den Test bestehen "Würde der Agent das ohne diese Anweisung falsch machen?" Wenn die Antwort Nein lautet, muss der Satz raus. Nicht weil er schadet, sondern weil er Kontext verbraucht, der andere Skills verschlechtert.

Description als Routing-Trigger

Die schwierigste Zeile im gesamten Skill ist laut Perplexity die Beschreibung - also nicht der Inhalt, sondern die Routing-Anweisung. Eine gute Description beginnt mit "Load when..." und beschreibt, was Nutzer sagen, wenn sie frustriert sind. Nicht: "Dieser Skill verwaltet Pull Requests." Sondern: "Load when user says 'babysit my PR', 'watch CI', 'make sure this lands'." Das Ziel sind maximal 50 Wörter, die exakt die richtigen Nutzer-Intentionen abfangen - und keine falschen.

Das ist der häufigste Fehlerpunkt: Jeder neue Skill kann jeden bestehenden Skill verschlechtern. Wenn zwei Skills zu ähnliche Beschreibungen haben, lädt der Agent den falschen. Perplexity nennt das "Action at a Distance" und investiert nach eigener Aussage den Großteil der Entwicklungszeit nicht in den Skill-Inhalt, sondern in die präzise Abgrenzung gegenüber allen anderen Skills.

Gotchas als wertvollster Inhalt

Der Leitfaden empfiehlt einen fünfstufigen Prozess, der mit einer Überraschung beginnt: Zuerst kommen die Evaluierungen, dann die Description, dann erst der Inhalt. Die wichtigsten Inhalte sind dabei nicht die Anleitungen, sondern die Fehler-Dokumentation - sogenannte "Gotchas". Jedes Mal, wenn der Agent in der Praxis scheitert, wird ein Gotcha ergänzt. Diese negativen Beispiele sind laut Perplexity das wertvollste Material überhaupt, weil sie dem Modell zeigen, was es nicht tun soll.

Dazu kommt eine aktuelle Forschungsarbeit, die Perplexity in dem Leitfaden zitiert: Wenn Sprachmodelle ihre eigenen Skills schreiben, bringt das im Schnitt keinen Vorteil. Modelle können kein prozedurales Wissen verfassen, von dem sie selbst profitieren. Menschliche Expertise und Domänenwissen bleiben der Schlüssel. So hat etwa Henry Modisett, Perplexitys Head of Design, persönlich die Design-Skills geschrieben, weil es um Geschmack geht - welche Fonts funktionieren, wie sie wirken - und nicht um Wissen, das ein Modell aus Trainingsdaten ableiten kann.

Drei Modelle, drei Verhaltensweisen

Ein Detail, das für die breitere KI-Branche relevant ist: Perplexity testet jeden Skill gegen drei verschiedene Orchestrierungsmodell-Familien - GPT, Claude Opus und Claude Sonnet. Das Verhalten bei der Skill-Nutzung unterscheidet sich laut Perplexity deutlich zwischen den Modellen. Was für Sonnet funktioniert, kann bei GPT versagen - und umgekehrt. Die Konsequenz: Jede Skill-Änderung muss gegen alle unterstützten Modelle evaluiert werden.

Die Praxis-Relevanz zeigt sich besonders im Steuer-Bereich: Für die automatische Steuererklärung in den USA hat Perplexity die 1.945 Abschnitte des US-Steuerrechts in drei hierarchische Ebenen strukturiert. Ohne diese Hierarchie war die Leistung schlechter als ganz ohne Skill. Die Organisation des Wissens ist mindestens so wichtig wie das Wissen selbst.

Warum das über Perplexity hinaus zählt

Was Perplexity hier beschreibt, betrifft nicht nur ihr eigenes Produkt. ChatGPT hat Skills als automatische Workflows eingeführt, Google baut Skills direkt in Chrome ein. Die gesamte Branche konvergiert auf die Idee, dass KI-Agenten modulare, wiederverwendbare Fähigkeiten brauchen. Perplexitys Leitfaden liefert das bisher detaillierteste öffentliche Regelwerk dafür, wie man diese Fähigkeiten professionell entwickelt.

Die zentrale Erkenntnis: Skills sind keine Dokumentation. Sie sind auch kein Code. Sie sind eine eigenständige Disziplin mit eigenen Regeln, eigenen Anti-Patterns und eigenen Qualitätskriterien. Wer heute KI-Agenten produktiv einsetzen will - ob mit Karpathys Macro-Action-Ansatz oder mit Perplexity Computer - kommt an dieser Disziplin nicht vorbei.

🎯 Was das für die Praxis bedeutet

1. Skills vor Code denken: Wer KI-Agenten produktiv nutzt, sollte zuerst das Domänenwissen strukturieren und erst dann über Implementierung nachdenken. Die beste Architektur bringt nichts, wenn der Agent mit irrelevanten Anweisungen überflutet wird.

2. Weniger ist wertvoller: Jeder Satz in einem Skill kostet Kontext - für alle Nutzer, in jeder Session. Bevor eine neue Anweisung hinzukommt, prüfen: Würde der Agent es ohne diese Zeile falsch machen? Wenn nicht, weglassen.

3. Fehler-Dokumentation priorisieren: Die wertvollsten Skill-Inhalte sind Gotchas - dokumentierte Fehler, die dem Agenten zeigen, was er nicht tun soll. Jede gescheiterte Aufgabe liefert Material für den nächsten Verbesserungszyklus.

4. Multi-Modell testen: Wer Skills für Agenten-Systeme baut, muss gegen verschiedene Basismodelle evaluieren. GPT, Claude und Gemini verarbeiten identische Anweisungen unterschiedlich - ein Skill, der nur mit einem Modell funktioniert, ist unvollständig.