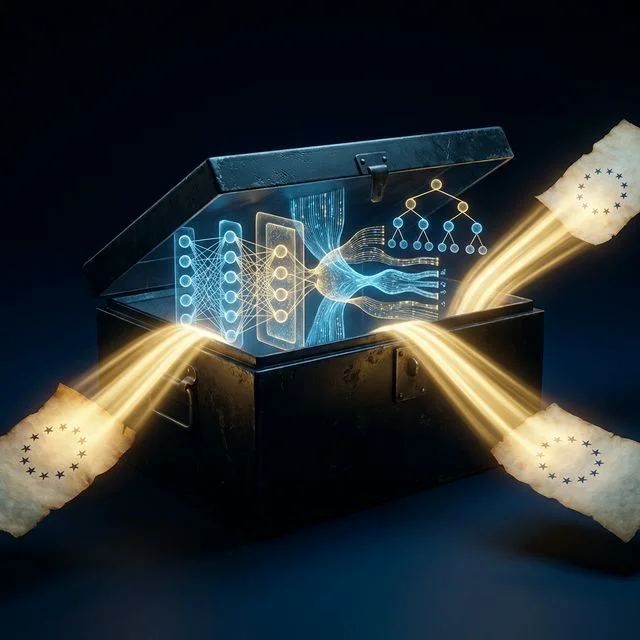

In der Open-Source-Community herrscht spürbare Unruhe: Der anlaufende EU AI Act macht auch vor sogenannten General-Purpose AI (GPAI) Modellen nicht halt. Die zentrale und hochgradig umstrittene Frage lautet: Wird hier die offene, dezentrale Entwicklung - der unbestritten wichtigste Motor der KI-Demokratisierung - im Keim erstickt (Euractiv)?

Was der EU AI Act von GPAI-Anbietern verlangt

Der finale Gesetzestext fordert für Basismodelle (GPAI) umfangreiche technische Dokumentationen und strikte Copyright-Compliance. Seit August 2025 gelten für alle neu auf den europäischen Markt gebrachten GPAI-Modelle die weitreichenden Transparenzpflichten nach Artikel 53.

Das bedeutet konkret: Anbieter müssen eine detaillierte Zusammenfassung ihrer oft terabyte-großen Trainingsdaten bereitstellen und lückenlos nachweisen, dass sie die strenge EU-Urheberrechtsrichtlinie (Opt-Out-Verfahren für Webscraping) einhalten.

Besonders kritisch wird es bei Modellen, denen ein sogenanntes 'systemisches Risiko' attestiert wird. Ein Modell gilt automatisch als systemisch riskant, wenn für sein initiales Training mehr als 10^25 Fließkomma-Operationen (FLOPs) aufgewendet wurden - eine gigantische Rechenschwelle, die aktuell große Frontier-Modelle wie Llama 3.1 405B, Gemini 1.5 Pro oder GPT-5 spielend überschreiten. Für derartige Modelle verlangt die EU-Kommission unter anderem:

- Umfassende und begleitende interne Risikobewertungen

- Aufwendiges Adversarial Testing (Read-Teaming durch externe Sicherheitsexperten)

- Proaktive Cybersicherheitsmaßnahmen und zwingendes Incident Reporting bei Vorfällen

- Regelmäßige technische Sicherheitsevaluierungen und Meldungen an das AI Office

Diese massiven personellen und finanziellen Anforderungen sind für kleine Open-Source-Entwickler und Forschungsteams schlichtweg nicht stemmbar. Zwar gibt es im Gesetz theoretische Ausnahmen für die reine Grundlagenforschung und kleinere Open-Source-Modelle, doch die juristische Grenze ist beunruhigend fließend.

Die Open-Source-Ausnahme - und ihre Tücken

Die vermeintlich gute Nachricht für die Open-Source-Community: Der AI Act gewährt GPAI-Modellen, die unter einer klassischen, freien Lizenz veröffentlicht werden, bestimmte regulatorische Erleichterungen. Open-Source-Modelle "ohne systemisches Risiko" sind zumindest von der Pflicht befreit, aufwendige technische Dokumentation an nachgelagerte App-Entwickler oder das neu eingerichtete EU AI Office zu liefern (Capgemini).

| Modellkategorie | Systemisches Risiko (>10^25 FLOPs) | Transparenzpflicht (Training) | Vollständige AI-Act-Pflichten |

|---|---|---|---|

| Open Source "klein" | Nein | Ja | Teilweise befreit |

| Open Source "groß" | Ja (z.B. Llama 405B) | Ja | Ja (volle Härte) |

| Proprietäre API-Modelle | Vollumfänglich | Ja | Ja (volle Härte) |

Die schlechte Nachricht liegt im Kleingedruckten: Die rigorose Copyright-Compliance und die aufwendige Zusammenfassung der Trainingsdaten gelten auch für Open-Source-Modelle - fast ausnahmslos. Und wenn ein Open-Source-Modell die FLOP-Rechenschwelle überschreitet (als systemisch riskant eingestuft wird), greifen die Gesetze wie für Big Tech. Die Ausnahme nützt also langfristig nur akademischen Experimenten und Nischenmodellen.

Der Zeitplan: Wann wird es ernst?

Die rechtliche Uhr tickt bereits: Die GPAI-Pflichten gelten seit August 2025 verbindlich für alle neuen Modelle in Europa. Im August 2026 treten harte behördliche Durchsetzungsmechanismen bei Verstößen in Kraft. Modelle, die noch vor August 2025 veröffentlicht wurden, genießen aktuell noch eine verlängerte "Grandfathering"-Übergangsfrist bis August 2027.

Kritiker von GitHub, Hugging Face und der EFF argumentieren, dass Open-Source-Entwickler naturgemäß keine Kontrolle darüber haben, wie ihre Weights von Dritten eingesetzt (oder missbraucht) werden. Sie für potenzielle Schäden haftbar zu machen, bremse die Innovation. Die Gegenposition der EU vergleicht dies mit Produktsicherheit: Wer ein potenziell gefährliches Werkzeug in den Markt entlässt, trägt zwingend Verantwortung für dessen Risikoprofil.

Quellen:

- Capgemini: Open Source GPAI: Privilegierung und Pflichten im Rahmen des EU AI Act

(November 2025)

- EU AI Act:

High-level summary of the AI Act (Laufend aktualisiert)

📊 Einordnung

Der Gesetzgeber wagt hier einen riskanten Balanceakt. Zu viel rechtliche Härte könnte das zarte Pflänzchen der europäischen Open-Source-Szene schnell abwürgen - in einem rasanten Markt, den die USA und Asien heute schon fast vollständig dominieren. Zu wenig Kontrolle wiederum öffnet die Tür für ungebremsten Missbrauch und Deepfakes in kritischen Infrastrukturen.

Ein drängendes Problem: Die statische Grenze von 10^25 FLOPs ist nicht zukunftsfest. Da durch ständige Hardware-Innovation die Rechenkosten pro Training exponentiell sinken, könnten bald auch Hobby-Modelle, die heute noch als harmlos gelten, diese rote Linie überschreiten. Die EU muss den Code of Practice agil halten.

🎯 Was bedeutet das konkret?

Ob Sie ein Softwarelösung integrieren oder an Grundlagen forschen - der AI Act wird Sie unmittelbar betreffen:

1. Für Open-Source-Entwickler: Nutzen Sie proaktiv standardisierte Model Cards nach Hugging Face

Vorbildern, um sofort Transparenz zu schaffen. Wer jetzt Dokumentations-Schulden anhäuft, wird 2026/2027 ein

massives Compliance-Problem haben.

2. Für einsetzende Unternehmen (Deployer): Als 'Deployer' nimmt der AI Act auch Sie

bei der Nutzung komplett in die Pflicht - egal ob Sie ein Open-Source-Llama-Basis-Modell oder die GPT-API

betreiben. Prüfen Sie dringend Ihre gesamte interne KI-Lieferkette auf Konformität (EU-ISO Standards

evaluieren).

3. Für AI-Officer: Verfolgen Sie als Verantwortlicher die Konsultationen zum europäischen

Code of Practice für GPAI - dieses Dokument wird die konkreten Audit-Standards für die nächsten Jahre

verbindlich definieren.