Sind Sie bereit für die neuen Kollegen aus dem Rechenzentrum? Mit den KI-Agenten bricht ein jahrtausendealtes Prinzip der Innovation: Zum ersten Mal in der Geschichte wird Technologie nicht nur Werkzeug, sondern gleichzeitig auch dessen Bediener. Das Rad brauchte jemanden, der es drehte. Der Webstuhl brauchte einen Weber. Der Computer brauchte einen Programmierer. Der KI-Agent braucht - niemanden.

Das Ende des Werkzeug-Paradigmas

Seit der Erfindung des Faustkeils folgt jede technologische Revolution demselben Muster: Der Mensch erfindet ein Werkzeug, das seine Fähigkeiten verstärkt, und bleibt dabei der Akteur. Das Werkzeug tut nichts von sich aus. Es wartet darauf, benutzt zu werden.

KI-Agenten durchbrechen dieses Paradigma. Ein Agent wie Claude Code, Devin oder GPTs mit Tool-Nutzung ist kein passives Werkzeug mehr. Er beobachtet, plant, entscheidet und handelt - in Schleifen, die stunden- oder tagelang ohne menschliches Eingreifen laufen können. Er schreibt Code, testet ihn, korrigiert Fehler, committet ins Repository und öffnet Pull Requests. Er liest E-Mails, extrahiert Aufgaben, priorisiert sie und arbeitet sie ab.

Kollegen, nicht Werkzeuge

Das verändert die Metapher grundlegend. Ein Hammer ist ein Werkzeug. Excel ist ein Werkzeug. ChatGPT ist (noch) ein Werkzeug. Aber ein KI-Agent, der eigenständig in Ihrem Firmennetz agiert, Entscheidungen trifft und Ergebnisse produziert, ist kein Werkzeug mehr - er ist ein Kollege. Ein Kollege ohne Mittagspause, ohne Urlaubsanspruch, ohne Ego-Konflikte. Aber auch ohne Intuition, ohne moralisches Urteil und ohne die Fähigkeit, zu sagen: „Das fühlt sich falsch an."

Für Führungskräfte bedeutet das eine fundamentale Neuausrichtung: Management wird zur Orchestrierung von menschlichen und maschinellen Mitarbeitern. Die Fragen, die sich stellen, sind neu und unbequem:

- Wer ist verantwortlich, wenn ein Agent einen Fehler macht - der Manager, der ihn eingesetzt hat? Der Entwickler, der ihn programmiert hat? Das Unternehmen, das ihn lizenziert hat?

- Wie bewertet man die „Leistung" eines Agenten? Nach Output? Nach Qualität? Nach eingesparten Personalkosten?

- Was passiert mit dem Teamgefüge, wenn ein Agent mehr Output produziert als drei menschliche Kollegen zusammen?

Die psychologische Dimension

Was selten diskutiert wird: Die Integration von KI-Agenten in menschliche Teams ist nicht primär ein technisches, sondern ein psychologisches Problem. Studien der Stanford University zeigen, dass Menschen, die langfristig mit autonomen KI-Systemen zusammenarbeiten, dazu neigen, ihre eigenen Fähigkeiten zu unterschätzen - ein Phänomen, das als „AI Inferiority Effect" beschrieben wird.

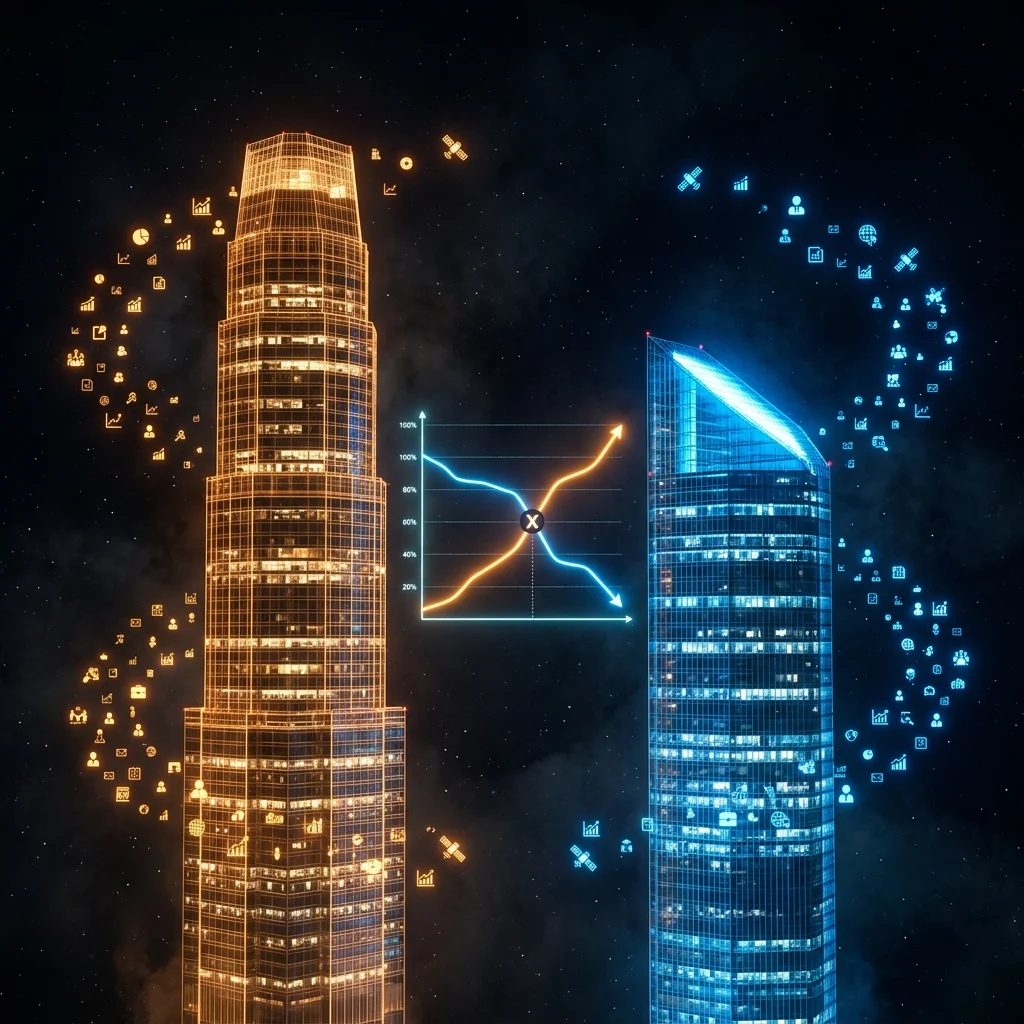

Gleichzeitig entsteht ein neues Statusgefüge: Wer den Agenten steuern kann, gewinnt an Einfluss. Wer durch den Agenten ersetzt werden kann, verliert ihn. Die Unternehmenskultur der nächsten Jahre wird sich an dieser Bruchlinie entlangentwickeln.

📊 Einordnung

Der Übergang von „KI als Werkzeug" zu „KI als Akteur" ist keine technische Nuance - es ist ein zivilisatorischer Bruch. Zum ersten Mal delegieren wir nicht nur Arbeit an Maschinen, sondern auch Entscheidungen, Planung und Problemlösung. Die Implikationen reichen weit über die Wirtschaft hinaus und berühren Fragen der menschlichen Identität: Wenn Maschinen alles können, was wir können - was definiert dann noch unseren Wert als Arbeitende, als Denkende, als Handelnde?

🎯 Was bedeutet das konkret?

- Für Führungskräfte: Beginnen Sie jetzt, Ihr Team auf die Zusammenarbeit mit KI-Agenten vorzubereiten. Definieren Sie klare Entscheidungsgrenzen: Was darf der Agent autonom tun? Was erfordert menschliche Freigabe?

- Für Mitarbeitende: Die wertvollsten Skills der nächsten 5 Jahre sind nicht Coding oder Datenanalyse, sondern die Fähigkeit, KI-Agenten effektiv zu orchestrieren und deren Ergebnisse kritisch zu bewerten.

- Für Unternehmen: Investieren Sie in Change Management, nicht nur in Technologie. Die größte Hürde der Agenten-Integration ist nicht die API, sondern die Akzeptanz im Team.