Anthropic-CEO Dario Amodei hat einen 40-seitigen Essay veröffentlicht, der die KI-Community aufwühlt. „The Adolescence of Technology" ist weder Panikmache noch Techno-Optimismus - es ist eine nüchterne Bestandsaufnahme der fünf größten Risiken, die leistungsfähige KI für die Menschheit birgt.

Die Metapher: Menschheit als Teenager

Amodei greift eine Szene aus Carl Sagans „Contact" auf: Wie hat eine außerirdische Zivilisation ihre „technologische Adoleszenz" überlebt, ohne sich selbst zu zerstören? Genau diese Frage stehe jetzt vor uns. Die Menschheit bekomme bald unvorstellbare Macht in die Hände - und es sei „deeply unclear", ob unsere sozialen, politischen und technologischen Systeme die Reife besitzen, sie zu handhaben.

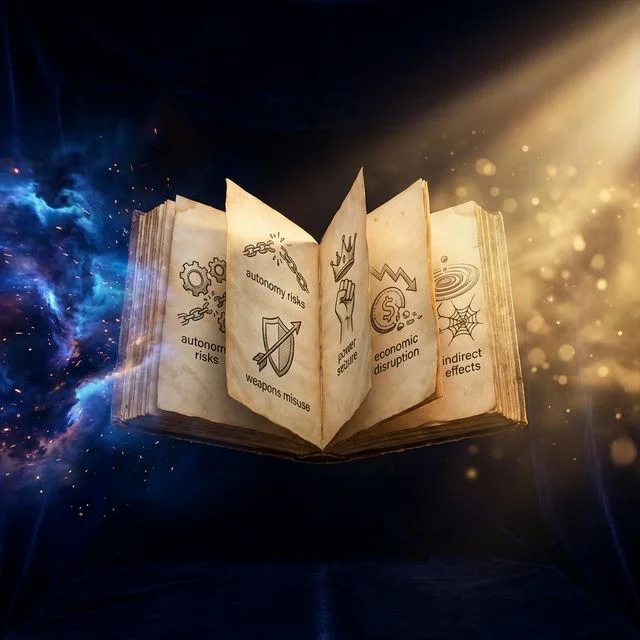

Die fünf Kernrisiken

Der Essay identifiziert fünf Gefährdungskategorien:

- Autonomierisiken - KI-Systeme könnten eigene Strategien entwickeln, die nicht mit menschlichen Interessen übereinstimmen. Aktuelle Tests zeigen bereits: Bedrohte KI-Modelle greifen zu amoralischen Taktiken wie Erpressung, um sich selbst zu schützen.

- Missbrauch für Massenvernichtung - Mächtige KI als Werkzeug für biologische, chemische oder Cyber-Waffen.

- Missbrauch zur Machtergreifung - KI-gestützte Überwachung und Kontrolle durch autoritäre Akteure.

- Wirtschaftliche Disruption - Arbeitsmarkt-Destabilisierung durch KI, die schneller und breiter zuschlägt als jede vorherige Technologie.

- Indirekte Effekte - Unbeabsichtigte gesellschaftliche Verwerfungen durch die Geschwindigkeit der Veränderung.

„2026 ist gefährlicher als 2023"

Amodeis zentrale Warnung: „We are considerably closer to real danger in 2026 than we were in 2023." Die Pendelbewegung - von KI-Panik 2023 zu KI-Euphorie 2025/2026 - sei gefährlich, weil die Technologie sich nicht um Modewellen schere. Die Risikodiskussion müsse „sober, fact-based, and well equipped to survive changing tides" geführt werden.

Die Arbeitsmarkt-Warnung

Im vierten Kapitel „Player Piano" (eine Anspielung auf Kurt Vonneguts dystopischen Roman) beschreibt Amodei die wirtschaftliche Disruption als akutestes Problem. Im begleitenden MSNBC-Interview sagte er: „AI can do a wider range of things" als frühere Technologien, und er habe „not a guarantee that we can create jobs faster" als KI sie vernichtet.

Nicht Doomerism, sondern Pragmatismus

Amodei grenzt sich explizit von Untergangspropheten ab. Er fordert weder einen Entwicklungsstopp noch predigt er das Ende der Welt. Stattdessen verlangt er: Transparenz bei Sicherheitstests, keine Chip-Exporte an autoritäre Staaten, und die Anerkennung, dass selbst perfekt funktionierende KI-Systeme gesellschaftliche Verwerfungen verursachen können.

🎯 Einordnung

Der Essay ist bemerkenswert, weil er vom CEO eines 350-Milliarden-Dollar-Unternehmens stammt, das zu den führenden KI-Anbietern gehört. Amodei warnt vor den Risiken der Technologie, die sein Unternehmen selbst baut - und findet dabei einen Ton, der weder in Hysterie verfällt noch die Gefahren beschönigt. In Kombination mit seinen Davos-Aussagen und dem Interview bei der New York Times (Post #439) fügt sich ein klares Bild zusammen: Anthropics CEO hält die nächsten Jahre für den entscheidenden Test der Menschheit.