Seit acht Jahren beherrscht ein einziges Prinzip die gesamte KI-Textgenerierung: das autoregressive Modell. Ein Token nach dem anderen, von links nach rechts, wie eine Schreibmaschine. GPT, Claude, Gemini, Llama - sie alle arbeiten so. Jetzt stellt ein Startup dieses Fundament in Frage.

Inception Labs, gegründet von Stanford-Professor Stefano Ermon - einem der Pioniere hinter der Diffusion-Technologie, die Stable Diffusion und Midjourney erst möglich machte - hat Mercury 2 vorgestellt: das nach eigenen Angaben schnellste Reasoning-Sprachmodell der Welt. Und es funktioniert grundlegend anders als alles, was der Markt bisher kennt.

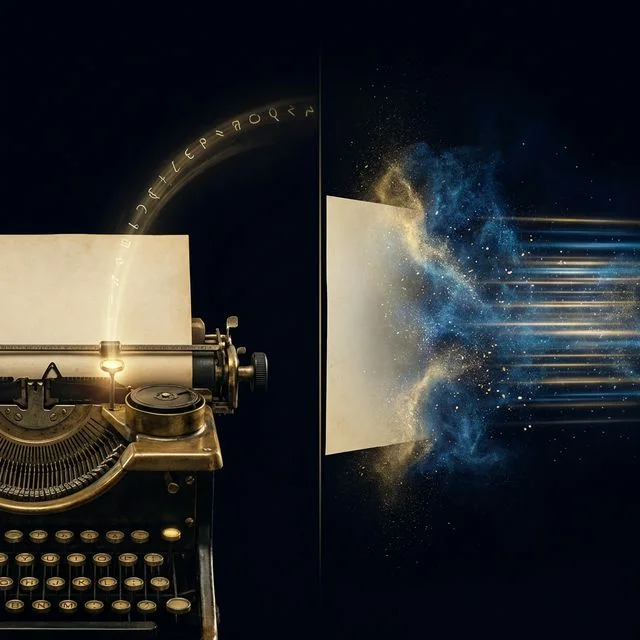

Diffusion statt Autoregression

Statt Token für Token zu generieren, erzeugt Mercury 2 Antworten durch parallele Verfeinerung - es arbeitet an mehreren Tokens gleichzeitig und konvergiert in wenigen Schritten zum fertigen Text. Die Analogie von Inception Labs: weniger Schreibmaschine, mehr „Editor, der einen ganzen Entwurf auf einmal überarbeitet". Das Ergebnis: über fünfmal schnellere Textgenerierung als vergleichbare speed-optimierte LLMs.

Die Zahlen sind beeindruckend: 1.009 Tokens pro Sekunde auf NVIDIA Blackwell GPUs. Zum Vergleich: Ein durchschnittlicher Mensch liest etwa 4 Wörter pro Sekunde. Mercury 2 generiert in derselben Zeit rund 750 Wörter. Bloomberg berichtet, das System sei darauf ausgelegt, Nutzeranfragen „deutlich schneller und günstiger" zu beantworten als bestehende Alternativen.

Warum die Geschwindigkeit alles verändert

Der entscheidende Punkt ist nicht die rohe Geschwindigkeit bei einer einzelnen Anfrage - sondern was sie für Agenten-Workflows bedeutet. Moderne KI-Systeme arbeiten in Schleifen: Dutzende von Inferenz-Aufrufen pro Aufgabe, verkettete Reasoning-Schritte, parallele Sub-Agenten. In diesen Schleifen multipliziert sich Latenz über jeden einzelnen Schritt. Was bei einer einzelnen Antwort kaum auffällt, wird in einem komplexen Agenten-Workflow zum Flaschenhals.

Die Kunden bestätigen den Effekt. „Mercury 2 ist mindestens doppelt so schnell wie GPT-5.2, und das ist ein Game Changer für uns", sagt Suchintan Singh, CTO von Skyvern. Max Brunsfeld, Mitgründer des Code-Editors Zed: „Vorschläge kommen so schnell, dass sie sich anfühlen wie Teil des eigenen Denkens."

Das Paradigma wird pluralistisch

Die strategische Bedeutung reicht über ein einzelnes Produkt hinaus. Wenn Diffusion als Architektur für Sprachmodelle funktioniert - und Mercury 2 ist der erste produktionsreife Beweis - dann steht die KI-Branche vor einer Diversifizierung ihrer technischen Grundlagen. Nicht ein Paradigma für alles, sondern verschiedene Architekturen für verschiedene Anforderungsprofile: Autoregression für maximale Qualität, Diffusion für maximale Geschwindigkeit. Mit einem Preis von $0,25 pro Million Input-Tokens und voller OpenAI-API-Kompatibilität positioniert sich Mercury 2 als sofortiger Drop-in-Ersatz für latenzempfindliche Anwendungen.

🎯 Was das für die Praxis bedeutet

1. Für Agenten-Entwickler: Diffusion LLMs könnten den Engpass in mehrstufigen Workflows beseitigen. Wer komplexe Agenten-Architekturen baut, sollte Mercury 2 als Speed-Layer evaluieren - die OpenAI-API-Kompatibilität macht den Test trivial.

2. Für die Branche: Das Monopol der autoregressiven Transformer-Architektur bekommt den ersten ernsthaften Riss. Wenn Inception Labs' Ansatz skaliert, entsteht ein neues Wettbewerbsfeld, bei dem Architekturinnovation wieder wichtiger wird als pure Modellgröße.

3. Für Voice-AI und Echtzeit-Anwendungen: Die Kombination aus Reasoning-Qualität und Echtzeit-Latenz löst ein Problem, das bisher als binärer Trade-off galt - entweder schnell oder intelligent. Mercury 2 verspricht beides.