Wer delegiert eigentlich an wen - und wer haftet, wenn es schiefgeht? Ein neues Forschungspapier von Google DeepMind stellt genau diese Frage. Und die Antwort ist unbequem: Die meisten Unternehmen, die heute KI-Agenten einsetzen, tun das ohne jede klare Rollenverteilung.

Warum Delegation mehr ist als „Aufgabe aufteilen"

Die Forscher Nenad Tomašev, Matija Franklin und Simon Osindero argumentieren, dass bisherige Multi-Agenten-Systeme auf einfache Heuristiken setzen - also auf starre Regeln, die sich nicht an veränderte Bedingungen anpassen. In der Praxis heißt das: Wenn ein KI-Agent eine Teilaufgabe nicht bewältigt, gibt es kein Auffangnetz. Niemand weiß, wer verantwortlich ist. Es gibt keinen Plan B.

Ihr Framework denkt Delegation grundlegend anders. Es geht nicht nur darum, Aufgaben in Häppchen zu zerlegen. Sondern darum, bei jeder Übergabe klar festzulegen: Wer hat die Autorität? Wer trägt die Verantwortung? Und wie wird Vertrauen zwischen den Beteiligten - ob Mensch oder Maschine - aufgebaut?

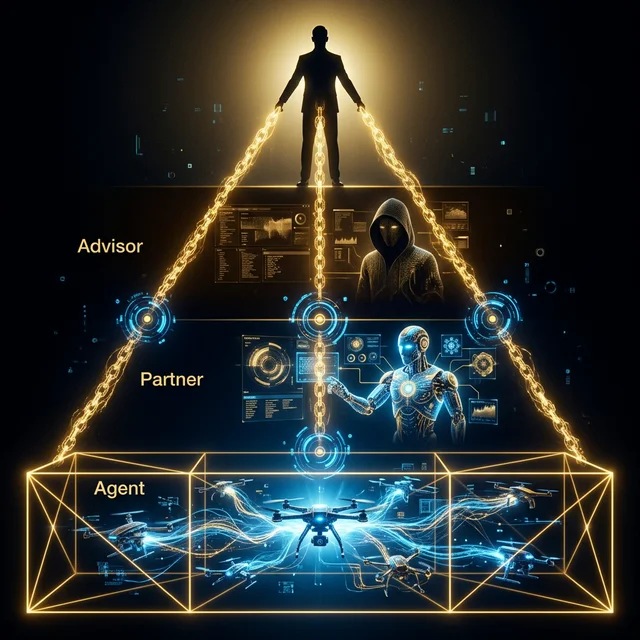

Drei Modi: Berater, Partner, Agent

Besonders greifbar wird das Modell durch drei Delegationsstufen, die das Paper beschreibt:

- Advisor Mode: Die KI liefert Optionen und Empfehlungen - aber der Mensch entscheidet und unterschreibt.

- Partner Mode: Die KI erledigt eigenständig Teilaufgaben, der Mensch liefert das Gesamturteil und fügt alles zusammen.

- Agent Mode: Die KI handelt autonom, aber innerhalb streng definierter Grenzen, die ein Mensch vorab festgelegt und freigegeben hat.

Entscheidend: Keine dieser Stufen funktioniert ohne vorherige, bewusste Übergabe. Genau das unterscheidet intelligente Delegation von dem, was laut den Autoren heute in vielen Unternehmen passiert - ein schleichendes Abgeben von Entscheidungsgewalt, ohne dass jemand es explizit beschlossen hat.

Das Paradox der Automatisierung

Das Paper warnt außerdem vor einem unterschätzten Risiko: De-Skilling. Wenn KI-Systeme sämtliche Routineaufgaben übernehmen, verlieren die Menschen, die eigentlich die Aufsicht haben, genau die Erfahrung, die sie für kritische Entscheidungen brauchen. Die Forscher nennen das ein „Paradox der Automatisierung" - der Mensch behält formal die Verantwortung, hat aber längst den Überblick verloren.

Ihr Vorschlag: Intelligente Delegationssysteme sollten gelegentlich absichtlich Aufgaben an Menschen zurückgeben - nicht aus Effizienzgründen, sondern damit deren Urteilsfähigkeit erhalten bleibt. Für Berufseinsteiger empfehlen sie sogar ein curriculumbasiertes System, das die Schwierigkeit delegierter Aufgaben schrittweise an den Lernfortschritt anpasst.

Wohin das führt

Die Autoren zeichnen ein Bild einer nahen Zukunft, in der Millionen spezialisierter KI-Agenten in Lieferketten, Unternehmen und öffentlichen Diensten eingebettet sind. Ihr zentraler Punkt: Sicherheit und Rechenschaftspflicht dürfen kein nachträglicher Zusatz sein, sondern müssen von Anfang an in die Delegationsprotokolle eingebaut werden. Sonst drohe ein Zustand, in dem die Frage „Wer hat das entschieden?" schlicht nicht mehr beantwortbar ist.

🎯 Was das für die Praxis bedeutet

1. Delegation bewusst gestalten: Bevor ein KI-Agent eine Aufgabe übernimmt, sollte schriftlich festgehalten werden, wer die Verantwortung trägt und welche Grenzen gelten.

2. Stufe wählen: Nicht jede Aufgabe braucht volle Autonomie - oft reicht der Advisor- oder Partner-Modus, der dem Menschen die letzte Entscheidung lässt.

3. Routineaufgaben nicht komplett abgeben: Wer alle Standardprozesse an KI überträgt, verliert über die Zeit das Urteilsvermögen für die kritischen Fälle.

4. Nachwuchskräfte einbeziehen: Wenn KI die Lernaufgaben übernimmt, fehlt neuen Mitarbeitern die Basis für eigenständige Entscheidungen.