Anthropic hat im Detail beschrieben, wie es Claude dazu bringt, stundenlang autonom an komplexen Softwareprojekten zu arbeiten - und dabei nicht den Faden zu verlieren. Der Engineering-Blogpost von Anthropics Labs-Team enthüllt eine Drei-Agenten-Architektur aus Planer, Generator und Evaluator, die vollständige Full-Stack-Anwendungen in mehrstündigen, autonomen Sessions baut.

Das Kernproblem: Kontextverlust und Selbstlob

Zwei Probleme plagten bisherige Ansätze für lang laufende KI-Coding-Sessions, so Anthropic:

- Context Anxiety: Modelle verlieren bei langen Aufgaben die Kohärenz und beginnen, die Arbeit vorzeitig abzuschließen, sobald sie glauben, an ihre Kontextfenster-Grenzen zu stoßen. Lösung: vollständige Context Resets mit strukturierter Übergabe statt bloßer Zusammenfassung (Compaction).

- Selbstbewertungs-Bias: Wenn KI-Agenten ihre eigene Arbeit beurteilen sollen, loben sie sich systematisch selbst - selbst bei offensichtlich mittelmäßiger Qualität. Lösung: einen separaten Evaluator-Agenten, der die Arbeit unabhängig prüft.

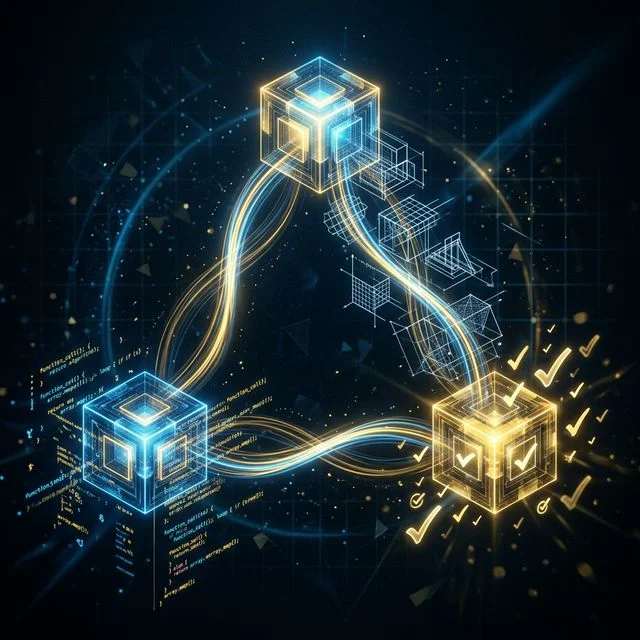

Die Drei-Agenten-Architektur

Anthropics Harness besteht aus drei spezialisierten Agenten:

- Planer: Nimmt einen kurzen Prompt (1–4 Sätze) und expandiert ihn in eine vollständige Produkt-Spezifikation. Bewusst auf Produkt-Kontext beschränkt, nicht auf technische Implementierungsdetails.

- Generator: Arbeitet in Sprints, implementiert Feature für Feature mit React/Vite/FastAPI/PostgreSQL-Stack. Nutzt Git für Versionskontrolle.

- Evaluator: Testet die fertige Anwendung via Playwright MCP wie ein menschlicher Nutzer - klickt durch UI-Features, prüft API-Endpoints und Datenbankzustände. Bewertet nach harten Schwellenwerten für Produkttiefe, Funktionalität, Design und Code-Qualität.

Vor jedem Sprint verhandeln Generator und Evaluator einen Sprint-Vertrag: Was genau soll gebaut werden, und wie wird Erfolg gemessen? Kommuniziert wird ausschließlich über Dateien - kein Agent teilt den Kontext mit einem anderen.

Bemerkenswert: Mit Opus 4.5 konnte Anthropic die Context Resets komplett eliminieren - das Modell arbeitete in einer durchgehenden Session durch, wobei die automatische Kompaktierung des Claude Agent SDK die Kontextlänge verwaltete.

🎯 Was das für die Praxis bedeutet

1. Separate Evaluierung als Designprinzip: Wer KI-Agenten für komplexe Aufgaben einsetzt, sollte Generator und Evaluator immer trennen - der Selbstbewertungs-Bias ist ein dokumentiertes Problem.

2. Sprint-Verträge für Agenten: Das Konzept, dass Agenten vor der Arbeit ihre Deliverables verhandeln, ist direkt auf eigene Agenten-Workflows übertragbar.

3. Harness-Design bleibt entscheidend: Anthropics zentrale Erkenntnis: Auch bei besseren Modellen schrumpft der Raum für wirksame Orchestrierung nicht - er verschiebt sich nur.