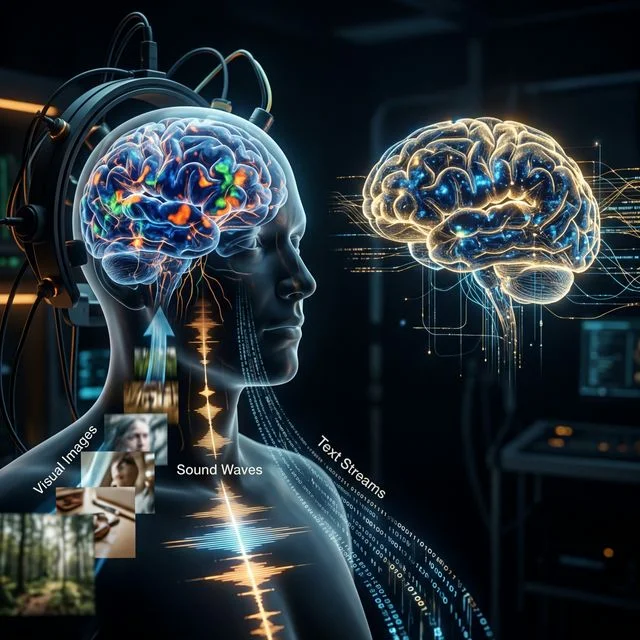

Meta hat ein KI-Modell veröffentlicht, das vorhersagt, wie das menschliche Gehirn auf Bilder, Sprache und Text reagiert: TRIBE v2 - der Trimodal Brain Encoder. Aus über 1.100 Stunden funktioneller Magnetresonanztomographie (fMRI) von mehr als 700 Probanden hat Meta ein Foundation-Modell trainiert, das als digitaler Zwilling neuronaler Aktivität funktioniert.

Was TRIBE v2 kann

Der Kern des Modells: Es erzeugt Zero-Shot-Vorhersagen - also Prognosen für völlig neue Probanden, Sprachen und Aufgabentypen, ohne zuvor darauf trainiert worden zu sein. Das bedeutet: TRIBE v2 kann abschätzen, wie ein Gehirn auf einen bestimmten Reiz reagiert, selbst wenn es diese Person noch nie „gesehen" hat.

Das Modell verarbeitet drei Modalitäten gleichzeitig: Visuelles, Auditives und Sprachliches. Die Architektur baut auf dem preisgekrönten System auf, das Meta beim Algonauts 2025 Challenge gewonnen hat - einem internationalen Wettbewerb für die Vorhersage neuronaler Repräsentationen.

Auf der interaktiven Demo-Seite lässt sich das Modell direkt ausprobieren: Nutzer können verschiedene Stimuli eingeben und sehen, welche Gehirnareale das Modell als besonders aktiv vorhersagt.

Warum das wichtig ist

TRIBE v2 ist kein weiteres Sprachmodell oder Bildgenerator. Es schlägt eine Brücke zwischen KI und Neurowissenschaft - und eröffnet Anwendungsfelder, die bisher an der Verfügbarkeit individueller Gehirndaten scheiterten. In der Medizin könnten solche Modelle künftig helfen, neurologische Erkrankungen zu diagnostizieren, ohne dass Patienten stundenlang im MRT liegen müssen.

Das Engagement auf der Ankündigung spricht für sich: Der Post auf X erreichte innerhalb von 24 Stunden über 3 Millionen Aufrufe - für ein Grundlagenforschungsprojekt ein ungewöhnlich breites Interesse.

🎯 Was das für die Praxis bedeutet

1. Neurowissenschaft wird skalierbar: Zero-Shot-Vorhersagen eliminieren die Notwendigkeit individueller Kalibrierung - ein Durchbruch für klinische Anwendungen.

2. Neue Schnittstelle Mensch-KI: Wer versteht, wie das Gehirn auf Reize reagiert, kann bessere Interfaces, Werbung und Lernsysteme bauen.

3. Open Research als Strategie: Meta veröffentlicht die Demo frei zugänglich - ein Signal, dass die Grundlagenforschung den Wettbewerbsvorteil bei KI-Hardware und -Plattformen stärken soll.