Was passiert, wenn Software-Anwendungen nur noch Datenbanken sind? Wenn die gesamte Intelligenz eines Unternehmens nicht mehr in den Apps steckt, sondern in den KI-Agenten, die sie bedienen? Genau dieses Szenario beschreibt Microsofts CEO Satya Nadella in einem fast anderthalbstündigen Gespräch beim BG2-Podcast - und obwohl das Interview bereits Ende 2024 entstand, ist seine Kernthese heute aktueller als je zuvor.

Software als Commodity, Agenten als Gehirn

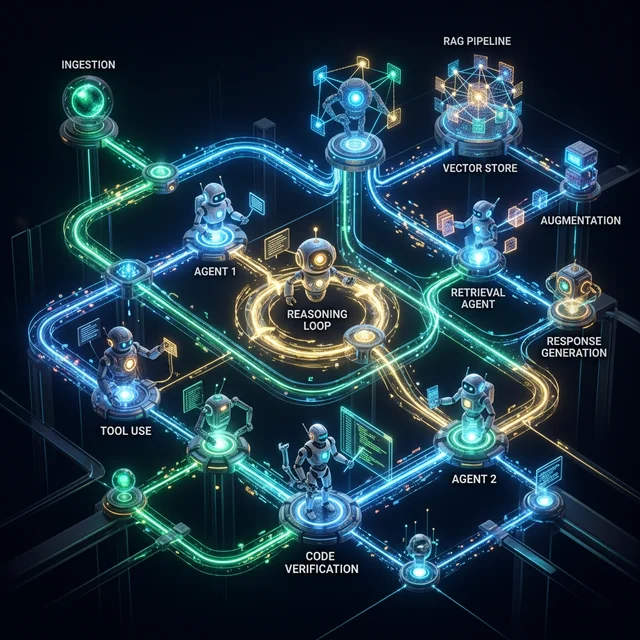

Nadellas zentrales Argument: Die Geschäftslogik wandert gerade von der Software zum KI-Agenten. Heute kaufen Unternehmen Anwendungen wegen ihrer spezifischen Funktionen und Regeln. In einer agentischen Zukunft werden diese Apps zu schlichten Datenbanken - sogenannte CRUD-Systeme (Create, Read, Update, Delete, also einfache Datenverwaltung). Die eigentliche Intelligenz, die Orchestrierung und das Schlussfolgern übernimmt der Agent. Er aktualisiert die Datenbanken nach Bedarf. Die Software wird zum austauschbaren Werkzeug, die KI zum Arbeiter und Denker.

Diese Einschätzung deckt sich mit dem, was Microsoft selbst gerade tut: Copilot ist nicht als weiteres Feature in Office gedacht, sondern als Schnittstelle zwischen Mensch und einer wachsenden Zahl autonomer KI-Systeme. Nicht der Nutzer soll seine Arbeitsweise radikal ändern - die KI soll sich in bestehende Abläufe einbetten.

Die OpenAI-Wette

Nadella spricht offen über die Entstehungsgeschichte der OpenAI-Partnerschaft. Microsofts CTO Kevin Scott habe damals erkannt, dass Google mit DeepMind bei KI vorne lag - und dass Microsoft den Anschluss nur durch eine strategische Allianz halten konnte. Nadella nennt OpenAI „das Unternehmen dieser Generation" und vergleicht es mit der Bedeutung von Google oder Meta in früheren Ären. Es sei keine Zufallsentscheidung gewesen, sondern eine bewusste Neuausrichtung, nachdem man „den letzten Zug bei der Cloud gerade noch erwischt" habe.

Unendliches Gedächtnis und sinkende Kosten

Besonders aufschlussreich ist Nadellas Vision für die nächste Generation von KI-Agenten: Systeme mit nahezu unbegrenztem Gedächtnis, die Aufgaben eigenständig erledigen, ohne bei jeder Interaktion den Kontext zu verlieren. Er weicht auch den heiklen Fragen zu den gigantischen Infrastrukturkosten nicht aus. Seine Antwort: Die Kosten für Modelltraining und Inferenz (also den Betrieb der Modelle) fallen schnell genug, um die Investitionen zu rechtfertigen - ein Muster, das Microsoft bereits von Azure kenne.

Offenheit schlägt Abschottung

Zur Frage offener versus geschlossener KI-Modelle positioniert sich Nadella pragmatisch: Sicherheit sei nicht verhandelbar, aber ein offenes Ökosystem treibe Innovation schneller voran als proprietäre Abschottung. Das erkläre, warum Microsoft gleichzeitig in OpenAI investiere und eigene Open-Source-Modelle fördere. Und zum Ende des Gesprächs liefert er den vielleicht schärfsten Satz: Von der antiken griechischen Zivilisation bis ins moderne Silicon Valley gebe es nur eine Sache, die Zivilisationen, Länder und Unternehmen gleichermaßen zu Fall bringe - Hybris.

🎯 Was das für die Praxis bedeutet

1. SaaS-Geschäftsmodelle überdenken: Wenn die Geschäftslogik zum Agenten wandert, verliert die App als Produkt an Wert. Unternehmen, die heute SaaS-Tools entwickeln, sollten prüfen, welchen Teil ihrer Wertschöpfung KI-Agenten künftig übernehmen könnten.

2. Agenten-Schnittstellen priorisieren: Nicht die perfekte Oberfläche entscheidet über den Erfolg, sondern die Fähigkeit, als Datenquelle und Ausführungsschicht für KI-Agenten zu dienen. APIs und strukturierte Daten werden wichtiger als Feature-Listen.

3. Infrastruktur skaliert besser als erwartet: Nadellas Argument sinkender Grenzkosten bei Training und Inferenz ist ein Signal: Wer heute in KI-Pilotprojekte investiert, profitiert morgen von deutlich günstigerer Rechenleistung.