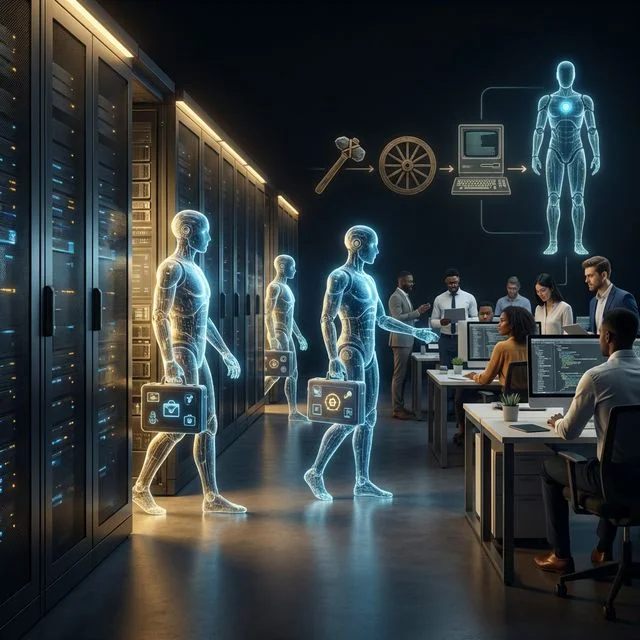

Die neuen Büro-Kollegen sitzen nicht mehr am Schreibtisch nebenan, sondern tief in gigantischen Rechenzentren. Was bisher oft nach abstrakter Zukunftsmusik klang, wird mit der Vorstellung von FDM-1 durch das Startup Standard Intelligence sehr konkret: Eine KI, die den Umgang mit Computern auf ein völlig neues Level hebt, indem sie autonom CAD-Programme bedient, komplexe Computerspiele meistert und sogar echte Fahrzeuge steuert.

Ein Modell, das den Computer "sieht"

Bisherige Ansätze für sogenannte Computer-Action-Modelle bauten auf Vision-Language-Modellen (VLMs) auf. Diese waren gezwungen, alle paar Sekunden Screenshots zu analysieren. Der Prozess war fehleranfällig, extrem ressourcenhungrig und für komplexe, langfristige Aufgaben wie verschachteltes Arbeiten in CAD-Programmen völlig ungeeignet.

FDM-1 (Forward Dynamics Model 1) geht einen völlig neuen Weg: Es wurde direkt mit 11 Millionen Stunden Video-Material gefüttert. Durch einen extrem effizienten Video-Encoder kann das System knapp zwei Stunden flüssiges 30-FPS-Video in einer Million Token verarbeiten. Das macht es nach Angaben der Entwickler 50-mal effizienter als bisherige Spitzenreiter. Für die Praxis bedeutet das: Die KI versteht endlich nicht mehr nur den momentanen Klick, sondern den gesamten Workflow der letzten Stunden.

Wie lernt eine KI das Klicken?

Das eigentliche Problem bei der Entwicklung war nicht die Rechenleistung, sondern die Trainingsdaten. Bisher mussten für das Training Zehntausende Stunden extrem teurer menschlicher Bildschirmaufzeichnungen mühsam annotiert werden. Um dieses Nadelöhr zu überwinden, hat Standard Intelligence quasi den Spieß umgedreht.

Sie trainierten zuerst ein "Inverse Dynamics Model" (IDM), das sich unzählige YouTube-Videos, Twitch-Streams und Tutorials ansah und vollautomatisch ableitete, welche Tasten- oder Mausbewegungen zu dem auf dem Video sichtbaren Ergebnis geführt haben müssen. So konnten sie über 11 Millionen Stunden ohnehin im Internet verfügbares Video-Material nutzen, um das eigentliche Handlungsmodell FDM-1 zu trainieren.

Latenz im Millisekundenbereich

Damit FDM-1 auch im echten Einsatz reibungslos funktioniert, haben die Entwickler ein massives Testnetzwerk aufgebaut. Über eine Million Simulationen pro Stunde laufen in 80.000 virtuellen Maschinen. Das Ergebnis: Die Reaktionszeit vom Erfassen des Bildschirms bis zur Ausführung der nächsten Aktion liegt bei nur noch 11 Millisekunden - schneller als jeder menschliche Nutzer.

Besonders faszinierend: Das Verständnis der KI für Bildschirminhalte ist so tief, dass das Modell mit kaum einer Stunde zusätzlichem Finetuning sogar in der Lage war, ein virtuelles Auto in San Francisco zu steuern.

Die wahre Sprengkraft liegt in der Kombination

Dass KI-Agenten Computer bedienen, sehen wir in frühen Ansätzen schon heute durch Frameworks wie OpenClaw oder Anthropics „Computer Use“. Doch der technische Ansatz von FDM-1 greift sehr viel tiefer.

Die ständige Diskussion in der Forschung, ob reine große Sprachmodelle (LLMs) eine Sackgasse sind und niemals zur künstlichen allgemeinen Intelligenz (AGI) führen werden, ist überbewertet und führt an der Realität vorbei. Die eigentliche Schlagkraft entsteht durch die Kombination von unterschiedlichen Technologien. So wie LLMs heute bereits in mehreren Schichten zusammenarbeiten oder Modelle wie Nano Banana und Googles Veo visuelles Weltverständnis und Sprache verknüpfen, liegt die Zukunft in einer Multimodell-Architektur.

Wenn hochspezialisierte Computer-Action-Modelle wie FDM-1 die „Augen und Hände“ für rechnende und logisch argumentierende LLMs (wie Claude Opus oder GPT-5) werden, entsteht ein neues Level an Agentic AI. Völlig unterschiedliche Modellarchitekturen werden nahtlos ineinandergreifen, um komplexe Wissens- und Handlungsarbeit autonom zu übernehmen.

🎯 Was das für die Praxis bedeutet

Die Art und Weise, wie Software bedient wird, steht vor einem radikalen Wandel:

1. Neue Interface-Paradigmen: Wenn KI-Agenten wie FDM-1 lernen, direkt mit grafischen Oberflächen zu interagieren, verschwindet künftig die Notwendigkeit für teure API-Integrationen zwischen Unternehmen. Der Agent navigiert souverän durch Altsysteme, als hätte er selbst Hände.

2. Skalierbare Expertise: Komplexe Tätigkeiten, wie beispielsweise die detaillierte Konstruktion in CAD-Systemen, können künftig rund um die Uhr delegiert werden. Unternehmen sollten prüfen, welche wissensintensiven, bildschirmbasierten Prozesse sich standardisieren lassen.

3. Massive Kostensenkung: Das Bottleneck der Datenannotation wurde durch das automatisierte Lernverfahren gelöst. Das bedeutet, wir werden in den kommenden 12 bis 18 Monaten einen exponentiellen Anstieg der Leistungsfähigkeit solcher "Computer-Agenten" sehen, die bald genauso alltäglich am Schreibtisch "sitzen" wie unsere menschlichen Kollegen.