Google DeepMind hat ein Paper veröffentlicht, das eine unbequeme Wahrheit auf den Punkt bringt: KI-Systeme können bereits bessere KI-Lernalgorithmen entwerfen als die Forscher, die sie gebaut haben. Das System heißt AlphaEvolve - und es macht den Prozess der Algorithmenfindung selbst zur KI-Aufgabe.

Quellcode als Genom

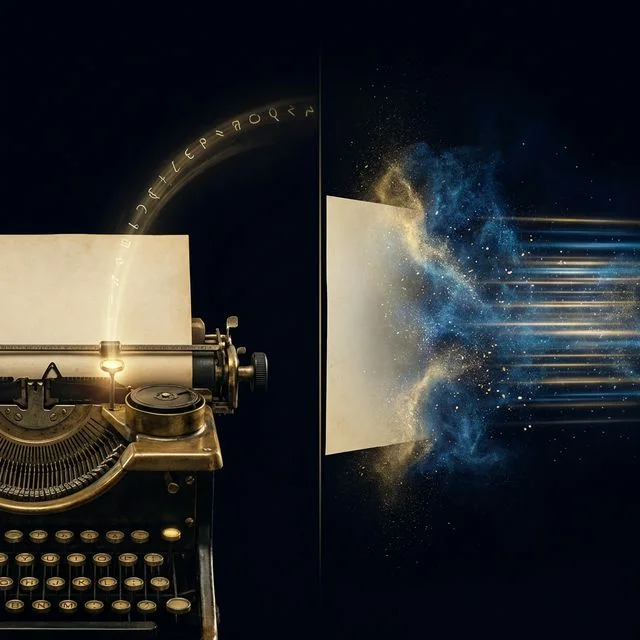

Das Prinzip ist elegant und beunruhigend zugleich: AlphaEvolve behandelt den Quellcode eines Algorithmus wie ein biologisches Genom. Ein LLM fungiert als Mutationsmaschine - es schlägt semantisch sinnvolle Code-Änderungen vor, evaluiert deren Fitness auf echten Game-Benchmarks, behält die Gewinner und evolviert sie weiter. Kein manuelles Tuning. Kein Trial-and-Error. Keine menschliche Intuition erforderlich.

Die Ergebnisse sind beeindruckend. AlphaEvolve entdeckte zwei neue Algorithmen, die den aktuellen Stand der Technik übertreffen:

VAD-CFR (Volatility-Adaptive Discounted CFR) schlägt alle bisherigen Baselines in 10 von 11 getesteten Spielen. Besonders bemerkenswert: Das System entdeckte einen „Warm-Start"-Schwellenwert bei Iteration 500 - ohne zu wissen, dass der Evaluierungshorizont bei 1.000 Iterationen lag. Es fand nicht-intuitive Mechanismen, die kein menschlicher Forscher manuell entworfen hätte.

SHOR-PSRO (Smoothed Hybrid Optimistic Regret PSRO) übertrifft etablierte Solver wie Nash, AlphaRank und PRD bei der Gleichgewichtsfindung in populationsbasierter Spieltheorie.

Die Rekursion, auf die niemand vorbereitet war

Die strategische Implikation geht weit über Spieltheorie hinaus. Was DeepMind hier demonstriert, ist ein Prototyp für rekursive Selbstverbesserung in einem begrenzten Bereich: Ein KI-System, das KI-Algorithmen verbessert, die wiederum eingesetzt werden können, um die nächste Generation von Systemen zu verbessern. Wie es Hasan Toor auf X formuliert: „Das ist die Rekursion, auf die niemand vorbereitet war."

Noch operiert AlphaEvolve in einem eng definierten Bereich - Multi-Agenten-Reinforcement-Learning in Spielen. Aber die Architektur ist generalisierbar. Wenn LLMs eines Tages ihre eigenen Trainingsmethoden, Architekturen oder Evaluierungskriterien optimieren, beginnt ein Zyklus, dessen Dynamik schwer vorherzusagen ist.

🎯 Was das für die Praxis bedeutet

1. Der Wert menschlicher: Intuition in der Algorithmenfindung sinkt. Was bisher jahrelange Forschungserfahrung brauchte - das Finden neuer Varianten etablierter Algorithmen - kann ein LLM-basierter Evolutionsprozess in Stunden leisten.

2. Für KI-Forscher verschiebt sich die Rolle: Statt Algorithmen zu designen, gestalten sie die Evaluierungsumgebungen und Fitness-Funktionen, in denen KI nach besseren Lösungen sucht. Der Forscher wird zum Kurator, nicht mehr zum Erfinder.

3. Die Debatte um rekursive Selbstverbesserung - lange ein theoretisches Konzept - bekommt mit AlphaEvolve einen konkreten Datenpunkt. Dies ist kein Science-Fiction-Szenario mehr, sondern ein publiziertes DeepMind-Paper mit reproduzierbaren Ergebnissen.