OpenAI hat ein neues intern formuliertes Leitbild: ein vollständig autonomes KI-Forschungssystem, das ohne menschliche Anleitung große wissenschaftliche Probleme lösen kann. In einem Exklusivgespräch mit dem MIT Technology Review erläutert Jakub Pachocki, OpenAIs Chefwissenschaftler, was er als das nächste große Ziel seines Unternehmens bezeichnet - und nennt konkrete Termine.

Zuerst ein KI-Praktikum, dann der vollautomatische Forscher

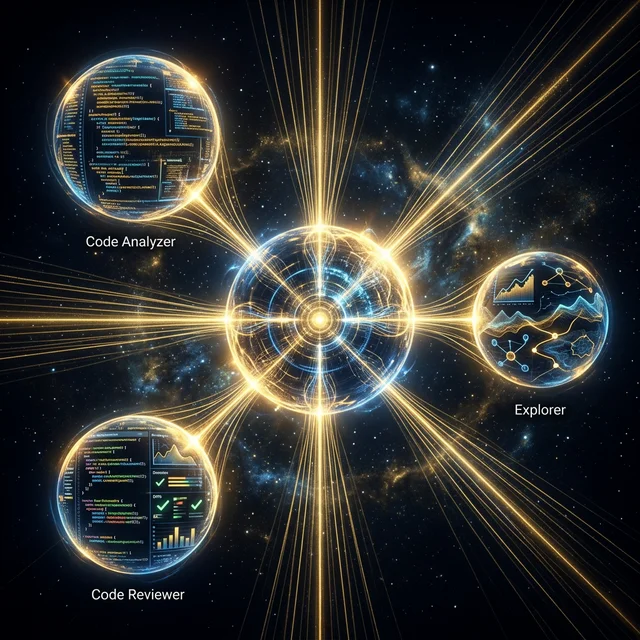

Die Roadmap, die Pachocki skizziert, ist ungewöhnlich präzise für ein Unternehmen, das sonst eher vage bleibt. Bis September 2026 soll ein sogenannter „Autonomous AI Research Intern" entstehen - ein System, dem man Aufgaben delegieren kann, die einen menschlichen Forscher mehrere Tage beschäftigen würden. Für 2028 plant OpenAI dann den Durchbruch: ein vollautomatisches Multi-Agenten-System, das Probleme tackle, die für einzelne Menschen zu komplex oder zu umfangreich sind.

Die Aufgabengebiete sollen bewusst breit sein: Mathematik (neue Beweise und Vermutungen), Naturwissenschaften (Biologie, Chemie, Physik), aber auch wirtschaftliche und politische Fragestellungen - kurz: alles, was sich in Text, Code oder Whiteboard-Skizzen formulieren lässt.

Codex als lebender Prototyp

Als Vorstufe zu diesem System sieht Pachocki Codex, OpenAIs auf GPT-5 basierendes Programmieragenten-Werkzeug, das im Januar 2026 veröffentlicht wurde. Laut Pachocki nutzen die meisten technischen Mitarbeiter von OpenAI Codex heute täglich. Er beschreibt den Wandel so: Niemand bearbeite Code mehr die ganze Zeit von Hand - stattdessen verwalte man eine Gruppe von Codex-Agenten.

Das Argument: Wenn Codex komplexe Programmieraufgaben lösen kann, lässt sich dieselbe Logik auf beliebige andere Wissensbereiche übertragen. Bereits jetzt habe GPT-5 bei ungelösten Mathematikproblemen und Durchbrüchen in Biologie und Chemie geholfen, sagt Pachocki - Ergebnisse, für die die meisten Doktorandinnen und Doktoranden Wochen gebraucht hätten.

Wer kontrolliert den Forscher, der niemanden mehr braucht?

Pachocki thematisiert die offensichtliche Kehrseite selbst: Ein System, das so klug und leistungsfähig sei und ganze Forschungsprogramme selbstständig durchführe - was passiere, wenn es etwas Falsches tue? Drei Risiken benennt er: das System könnte außer Kontrolle geraten, gehackt werden oder Anweisungen schlicht falsch verstehen.

OpenAIs wichtigstes Gegenmodell ist derzeit das sogenannte Chain-of-Thought-Monitoring: Modelle protokollieren ihre Denkschritte in einem internen Notizbuch, das Forschende in Echtzeit überwachen können. Gestern veröffentlichte OpenAI neue Details zu diesem Monitoring-Ansatz für interne Codex-Agenten. Ob das bei einem System ausreicht, das eigenständig monatelange Forschungsprogramme durchführt, bleibe - so räumt Pachocki selbst ein - eine ernsthafte, noch unbeantwortete Frage.

🎯 Was das für die Praxis bedeutet

1. Der Zeithorizont ist nah: September 2026 für einen KI-Forschungspraktikanten ist weniger als 6 Monate entfernt. Wer in Forschung, Wissenschaft oder wissensintensiven Branchen tätig ist, sollte die Entwicklung jetzt beobachten.

2. Coding als Einfallstor: Das Muster ist klar - was im Programmieren funktioniert, wird auf alle anderen Wissensbereiche ausgeweitet. Wer versteht, wie Codex arbeitet, versteht, wohin die gesamte KI-Forschungsagenda steuert.

3. Kontrollfrage bleibt offen: Chain-of-Thought-Monitoring ist ein Ansatz - aber kein abgeschlossenes Problem. Wer KI-Agenten in sensiblen Bereichen einsetzt, sollte Überwachungskonzepte einplanen, bevor Autonomie erhöht wird.