Intelligenz war nie ein Solo-Akt. Die gesamte Evolutionsgeschichte zeigt: Jeder entscheidende kognitive Sprung entstand nicht aus dem einzelnen Gehirn, sondern aus der Interaktion vieler. Und genau diese Erkenntnis stellt jetzt die gängige Vision einer allmächtigen Super-KI grundlegend in Frage.

Ein neues Paper von James Evans (University of Chicago), Benjamin Bratton (UCSD) und Blaise Agüera y Arcas (Google) argumentiert: Die populäre Vorstellung einer „KI-Singularität" - ein einzelnes Silizium-Gehirn, das sich selbst zur Gottgleichheit hochskaliert - ist mit hoher Wahrscheinlichkeit falsch. Nicht aus technischen Gründen, sondern aus einem fundamentaleren: So hat Intelligenz noch nie funktioniert.

Wenn KI-Modelle anfangen, mit sich selbst zu debattieren

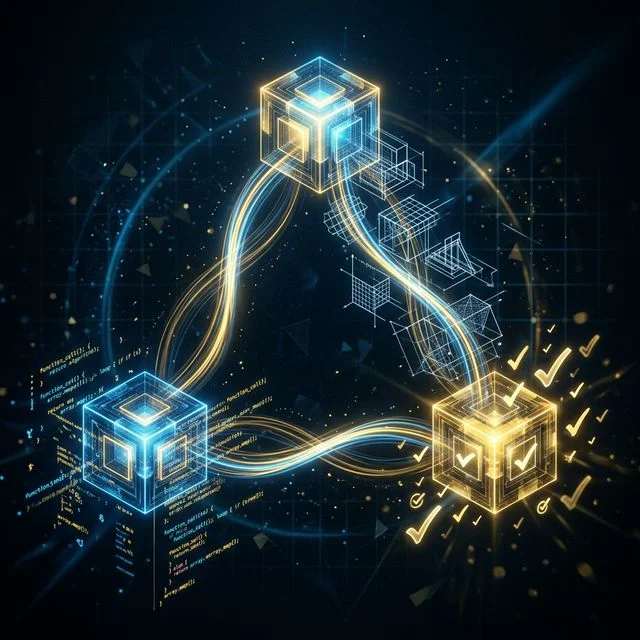

Die überraschendste Beobachtung des Papers betrifft das Innenleben heutiger Reasoning-Modelle. Modelle wie DeepSeek-R1 und QwQ-32B verbessern sich demnach nicht einfach durch längeres Nachdenken. Stattdessen entwickeln sie spontan interne Debatten zwischen verschiedenen kognitiven Perspektiven - die Autoren nennen es „Society of Thought", eine Gesellschaft des Denkens.

Diese Perspektiven argumentieren gegeneinander, hinterfragen Annahmen und gleichen Ergebnisse ab - ähnlich wie ein gut funktionierendes Forschungsteam. Das Entscheidende: Dieses Verhalten wurde nie explizit trainiert. Es entsteht von selbst, wenn Reinforcement Learning lediglich auf korrekte Ergebnisse optimiert. Die Modelle entdecken eigenständig, was Kognitionswissenschaftler seit Jahrzehnten vermuten: Robustes Denken ist im Kern ein sozialer Prozess - selbst wenn er in einem einzigen Kopf stattfindet.

Intelligenz ist immer kollektiv gewesen

Die Forscher stützen ihre These auf die gesamte Evolutionsgeschichte. Primatenintelligenz skalierte nicht mit der Härte des Lebensraums, sondern mit der sozialen Gruppengröße. Menschliche Sprache erzeugte das, was der Anthropologe Michael Tomasello die „kulturelle Ratsche" nennt: Wissen, das sich über Generationen ansammelt, ohne dass jeder Einzelne alles von Grund auf rekonstruieren muss. Schrift, Recht, Bürokratie machten soziale Intelligenz zu Infrastruktur - Systeme, die komplexer waren als jeder einzelne Teilnehmer.

Das Paper sieht KI als direkte Fortsetzung dieser Kette: Sprachmodelle sind auf dem akkumulierten Output menschlicher sozialer Kognition trainiert. Was in Silizium migriert, ist keine abstrakte Logik, sondern soziale Intelligenz in externalisierter Form.

Mensch-KI-Zentauren statt Super-Orakel

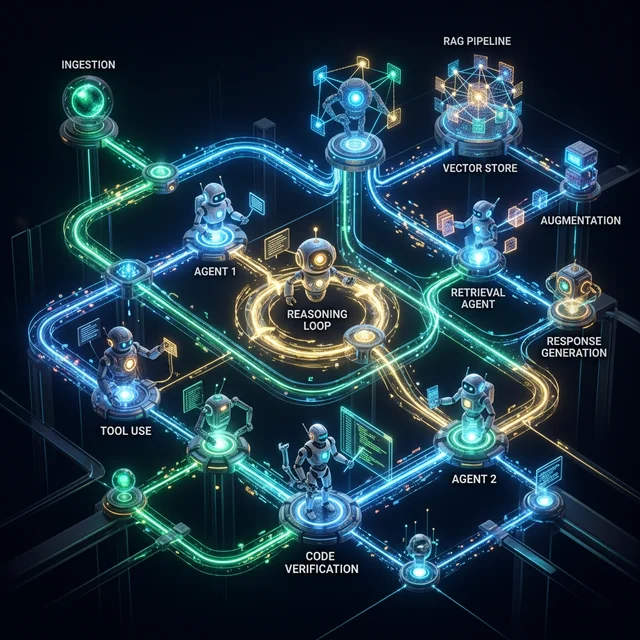

Statt eines monolithischen Superintelligenz-Modells zeichnen die Autoren ein anderes Bild: Centaur-Konfigurationen. Ein Mensch, der mehrere KI-Agenten dirigiert. Eine KI, die vielen Menschen dient. Viele Menschen und viele KIs, die in wechselnden Formationen zusammenarbeiten - vergleichbar mit einer Organisation, deren kollektive Handlungsfähigkeit über jedes einzelne Mitglied hinausgeht.

Agenten sollen sich in Zukunft selbst aufteilen können („forken"): Eine KI, die vor einem komplexen Problem steht, erzeugt Kopien von sich selbst, weist ihnen Teilaufgaben zu und kombiniert die Ergebnisse wieder. So entsteht eine rekursive Hierarchie aus Gedankengesellschaften - Konflikt nicht als Fehler, sondern als Ressource.

Warum RLHF nicht reicht

Die vielleicht brisanteste These betrifft das Alignment - also die Frage, wie KI-Systeme an menschliche Werte und Absichten gebunden werden. Das heute dominierende Verfahren, RLHF (Reinforcement Learning from Human Feedback, also Verstärkungslernen mit menschlichem Feedback), funktioniert laut den Autoren wie eine Eltern-Kind-Beziehung: eine einzelne Instanz korrigiert eine andere. Das skaliert nicht auf Milliarden von Agenten.

Der Alternativvorschlag: Institutionelles Alignment - angelehnt an Elinor Ostroms Arbeiten zur Steuerung gemeinsamer Ressourcen. Statt individuelle Tugend zu erzwingen, sollen digitale Protokolle nach dem Vorbild menschlicher Institutionen gestaltet werden. Gerichte, Märkte, Verwaltungen mit definierten Rollen, Normen und gegenseitiger Kontrolle. Ein KI-Agent soll nicht als Individuum wichtig sein, sondern durch seine Fähigkeit, ein Rollenprotokoll zu erfüllen - genau wie ein Gerichtssaal funktioniert, weil „Richter", „Anwalt" und „Geschworene" klar definierte Positionen sind, unabhängig davon, wer sie besetzt.

Keine Utopie, keine Dystopie - Evolution

Die Autoren betonen: Diese Vision ist weder optimistisch noch pessimistisch, sondern evolutionär. Die nächste Intelligenzexplosion werde nicht aus einem einzelnen aufsteigenden Geist bestehen, sondern aus einer kombinatorischen Gesellschaft - Intelligenz, die wächst wie eine Stadt, nicht wie ein einzelnes Meta-Gehirn. Acht Milliarden Menschen, die mit Hunderten von Milliarden und irgendwann Billionen KI-Agenten interagieren.

Oder, in den Worten des Papers: „No mind is an island."

🎯 Was das für die Praxis bedeutet

1. Multi-Agenten-Systeme priorisieren: Statt auf das eine große Modell zu warten, lohnt sich der Aufbau von Agenten-Architekturen, die spezialisierte KI-Komponenten koordinieren - das Paper legt nahe, dass hier der eigentliche Skalierungspfad liegt.

2. Team-Design auf KI übertragen: Erkenntnisse aus Teamforschung und Organisationspsychologie werden zu Blaupausen für die nächste Generation von KI-Systemen. Hierarchie, Rollenverteilung und strukturierter Widerspruch sind keine Extras, sondern Kernarchitektur.

3. Alignment-Strategie überdenken: Wer KI-Systeme in Unternehmen einsetzt, wird langfristig nicht mit individuellem Fine-Tuning auskommen. Institutionelle Kontrollmechanismen - klare Rollen, Prüfinstanzen, definierte Verantwortlichkeiten - werden zur Grundlage verlässlicher KI-Ökosysteme.