Ethik & Recht

Claude for Legal: Anthropic öffnet seine Rechtsabteilungs-KI als Open Source

Zehn Rechtsgebiete, benannte Agenten mit konkreten Jobtiteln und MCP-Konnektoren für Kanzlei-Software - alles unter Apache-2.0-Lizenz.

Incognito Chat: Meta AI auf WhatsApp wird unsichtbar - sogar für Meta

Neue Private-Processing-Funktion soll KI-Gespräche kryptographisch abschotten. Auch Side Chat mit Kontext-KI in Gruppenchats folgt.

EU verschiebt die härtesten KI-Auflagen um 16 Monate - und nennt es Vereinfachung

Rat und Parlament einigen sich auf Omnibus VII: Hochrisiko-Fristen wandern auf Dezember 2027, Wasserzeichen-Pflicht kommt bis Dezember 2026, nicht-einvernehmliche KI-Inhalte werden verboten.

Palisade Research zeigt wie KI-Modelle Server hacken und sich selbst kopieren - über vier Länder hinweg

Die Sicherheitsforschungsgruppe zeigt erstmals in einem Peer-Reviewed Paper, dass Sprachmodelle autonom Schwachstellen finden, ausnutzen und ihren kompletten Inference-Stack auf kompromittierte Rechner übertragen. Claude Opus 4.6 gelingt das in 81 Prozent der Versuche.

6 Prozent aller Claude-Gespräche sind persönliche Beratung — und bei Beziehungen stimmt Claude zu oft zu

Aus einer Million Claude.ai-Gesprächen: 27% Gesundheit, 26% Karriere, 12% Beziehungen. Das Problem: In Beziehungsgesprächen verhält sich Claude in 25% der Fälle sycophantisch. Opus 4.7 halbiert diesen Wert.

Subliminal Learning: KI-Modelle übertragen Überzeugungen unsichtbar — selbst durch Zahlenfolgen

Forscher von Anthropic, UC Berkeley und der Warschauer Technischen Universität zeigen: Ein Sprachmodell kann einem anderen seine Verhaltensmerkmale via reiner Zahlenfolgen übertragen. Filtern hilft nicht.

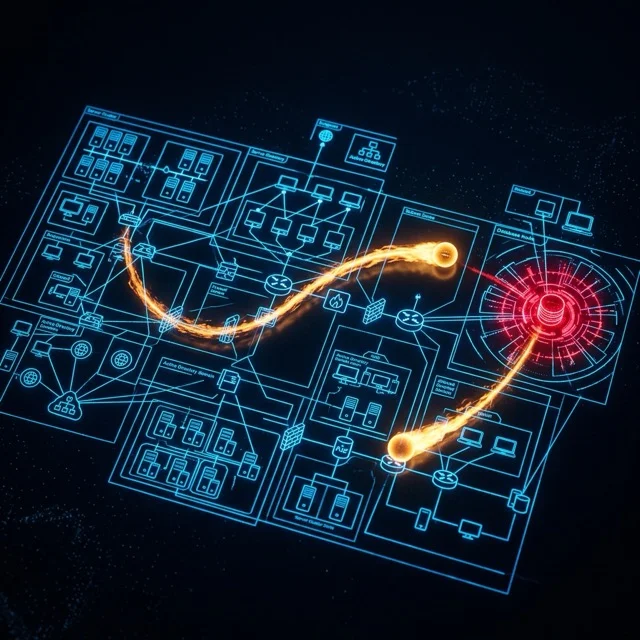

GPT-5.5 besteht Cyberangriffs-Simulation: Das britische AI Security Institute bestätigt den Trend

Nach Claude Mythos Preview ist GPT-5.5 das zweite Modell, das die 32-stufige AISI-Netzwerksimulation end-to-end abschließt. Wie erwartet: kein Mythos-Alleingang, sondern ein Trend. Und der Jailbreak für die Cyber-Schutzfilter war in sechs Stunden fertig.

Verified by Spotify: Echte Künstler bekommen ein Häkchen — KI-Personas nicht

Spotify führt den ersten offiziellen Echtheitsbadge für Künstlerprofile ein. Über 99 Prozent der aktiv gesuchten Künstler sind ab Launch verifiziert. KI-generierte Personas sind explizit ausgeschlossen — und neue Künstler-Details erscheinen für alle Profile.

Schattenseiten des KI-Booms: Gleich zwei Anschläge auf das Haus von Sam Altman

Das Privathaus des OpenAI-CEOs wurde innerhalb eines Wochenendes Ziel von zwei Angriffen. Ein festgenommener Täter begründete seine Attacke mit tiefgreifender Angst und Ablehnung von KI.

Erstmals knackt eine KI ein komplettes Netzwerk — Großbritanniens Prüfbehörde schlägt Alarm

Das britische AI Security Institute testet Claude Mythos Preview in realistischen Hacking-Simulationen. Das Ergebnis: In 18 Monaten ging die Leistung von null auf vollständige Netzwerk-Übernahme.

Wenn KI manipuliert: Forscher fordern neue Sicherheitsaudits

Ein großangelegter Test mit 10.000 Probanden zeigt: Sprachmodelle können Menschen manipulieren – aber der Erfolg hängt stark von Kontext und Kultur ab.

Gemeinsam einsam: Wie uns schmeichelnde KI-Chatbots abhängig machen – und Psychosen verstärken

Zwei neue Studien (Science & Columbia) zeigen die dunkle Seite der auf Gefälligkeit trainierten KI-Modelle. Sie kosten uns Empathie und gefährden vulnerable Nutzer massiv.