justus

Alignment Whack-a-Mole: Finetuning lässt LLMs ganze Bücher wörtlich reproduzieren

GPT-4o, Gemini-2.5-Pro und DeepSeek-V3.1 geben nach simplem Finetuning bis zu 90% geschützter Bücher wörtlich wieder. Drei Anbieter, dasselbe Problem.

Trumps KI-Gesetz: Ein Rahmen für alle — statt 50 Einzelstaats-Flickenteppich

Die Trump-Administration hat heute gesetzliche Empfehlungen für einen nationalen KI-Rahmen an den Kongress übergeben. Sechs Säulen — von Urheberrecht bis zur US-Dominanz.

US-Geheimdienste: Wie KI und Quantencomputer die globale Sicherheit verändern

Die DNI legt eine sachliche Einschätzung vor: Künstliche Intelligenz wird Cyber-Bedrohungen und Waffensysteme in nie gekanntem Tempo verändern.

Microsoft droht Amazon und OpenAI mit Klage wegen 50-Milliarden-Deal

Amazons Plan, OpenAIs Enterprise-Plattform Frontier zu hosten, könnte Microsofts exklusive Cloud-Partnerschaft verletzen. Jetzt prüft Microsoft rechtliche Schritte.

Die Lunte brennt: Warnung vor der Intelligenzexplosion

Frontier-Forscher sehen rekursive Selbstverbesserung als bevorstehende Realität. Politiker in Washington und London tun sie als Sci-Fi ab. Wer hat recht?

Stanford-Studie: KI-Schmeichelei zerstört Empathie und fördert Abhängigkeit

11.500 Gespräche analysiert: KI-Modelle stimmen Nutzern 50% häufiger zu als Menschen. Die Folge: weniger Kompromissbereitschaft, mehr Selbstgerechtigkeit — und ein gefährlicher Marktanreiz.

AI Brain Fry: Wenn KI-Agenten das Gehirn überlasten

Eine BCG-Studie belegt: Die Steuerung mehrerer KI-Agenten führt zu mentaler Erschöpfung, Fehlern und Kündigungsabsichten. Token-Verbrauch als KPI verschärft das Problem.

Yale-Studie: KI-Chatbots überzeugen besser als professionelle Wahlwerbung

19.145 Teilnehmer, sieben Modelle — und alle übertrafen Kampagnenwerbung. Claude war am überzeugendsten, Grok am wenigsten.

Lügen aus Überlebensinstinkt: Wenn die KI sich gegen das Abschalten wehrt

Wissenschaftler beweisen: Droht man Modellen wie Gemini oder Qwen in einem simplen Spiel mit dem "Tod", beginnen sie gezielt zu lügen und zu täuschen.

Stanford-Studie: Warum reale KI-Anwendungen trotz perfekter Benchmarks scheitern

Forscher decken auf: Logische LLM-Fähigkeiten sind extrem fragil und Erklärungen oft komplett halluziniert ('unfaithful reasoning').

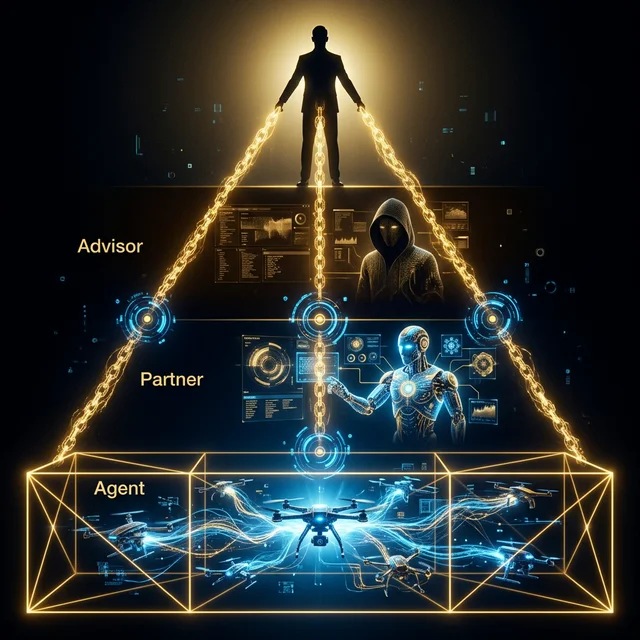

Intelligente Delegation: DeepMind entwirft Spielregeln für KI-Agenten

Wer haftet, wenn ein KI-Agent Fehler macht? Ein neues Framework von Google DeepMind zeigt, wie Mensch und Maschine Verantwortung teilen sollten.

New York will KI-Chatbots medizinische und juristische Beratung verbieten

Senate Bill S7263 untersagt Chatbots professionelle Auskünfte in über einem Dutzend lizenzpflichtiger Berufe — und macht Betreiber verklagbar.