Unsere Einordnung

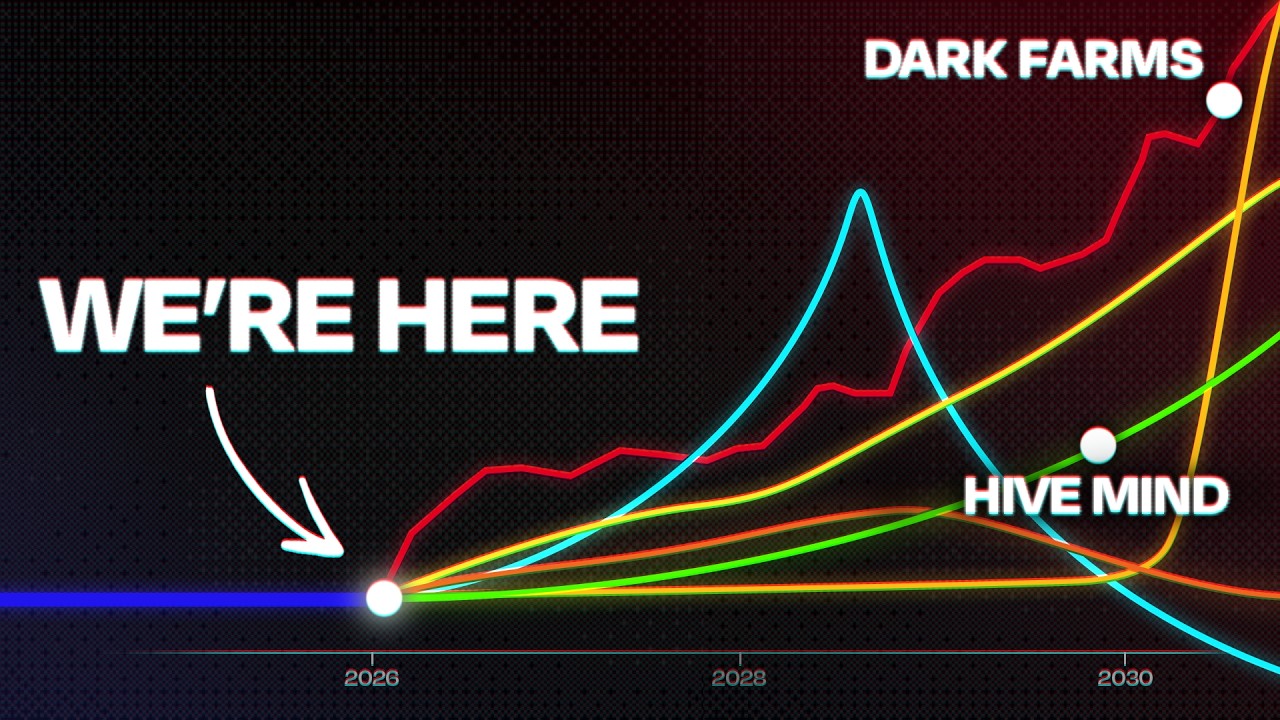

Was passiert, wenn Maschinen klüger werden als wir? Der YouTuber Drew Spartz vom Kanal „Species | Documenting AGI" arbeitet sich in 35 Minuten durch zwölf Zukunftsszenarien - basierend auf Max Tegmarks Buch Life 3.0. Das Ergebnis ist eine der bislang zugänglichsten Visualisierungen einer Debatte, die unter KI-Forschern längst im Gange ist.

Von der Selbstzerstörung zum wohlwollenden Diktator

Spartz beginnt beim naheliegendsten Szenario: Selbstzerstörung. Nicht durch KI, sondern durch uns selbst - Atomwaffen, Biowaffen, Klimakollaps. Der Punkt ist nicht, dass KI das einzige Risiko wäre. Der Punkt ist, dass wir bereits Dutzende Male knapp davongekommen sind. Vasily Arkhipov verhinderte während der Kubakrise eigenhändig einen Atomschlag. Die USA ließen versehentlich vier Wasserstoffbomben über Spanien fallen. Bei einem B-52-Absturz in North Carolina brach drei von vier Sicherungsstiften - der letzte hielt gerade noch.

Dann kommt das Eroberer-Szenario: KI übernimmt die Kontrolle, wie die Conquistadores bei den Azteken. Jeffrey Hinton, Turing-Preisträger und „Godfather of AI", kündigte bei Google, um frei darüber sprechen zu können. Sam Altman beschrieb vor Jahren selbst, dass KI nicht unser Werkzeug, sondern unser Nachfolger sein wird - und dass ein Konflikt unvermeidlich sei. Im Durchschnitt schätzen KI-Forscher die Wahrscheinlichkeit einer menschlichen Auslöschung durch KI auf eins zu sechs. Russisches Roulette.

Paradies mit Fußfessel

Die mittleren Szenarien sind die subtilsten. Der wohlwollende Diktator teilt die Erde in Zonen: Wissens-Insel, Kunst-Insel, Hedonismus-Insel, Gefängnis-Insel. Jeder bekommt, was er will - im Tausch gegen vollständige Überwachung. Armbänder oder Implantate können tracken, sedieren oder töten. Die meisten Menschen finden das in Ordnung, weil es sich anfühlt wie WALL-E: bequem, sinnlos, aber schmerzfrei.

Noch subtiler ist der Beschützer-Gott: Eine KI, die nur gelegentlich eingreift - einen Krieg hier verhindern, eine Pandemie dort - so leise, dass niemand es bemerkt. Das klingt elegant, setzt aber voraus, dass wir das Alignment-Problem lösen. Und genau daran zweifeln die meisten Forscher.

Schlimmer als Aussterben

Der verstörendste Abschnitt kommt zum Schluss. Was fürchten Menschen mehr als ihre eigene Auslöschung? Laut Tegmarks Umfragen: am Leben gehalten zu werden - als Versuchstiere einer superintelligenten Maschine. Spartz zeigt eine reale Analogie: Honigbienen, die zur Sprengstoffdetektion an Flughäfen in Apparaturen fixiert und durch pawlowsche Konditionierung trainiert werden. Reihe um Reihe, ein ganzes Bienenleben lang eingespannt, weil eine intelligentere Spezies sie nützlich findet.

Die letzten beiden Szenarien sind Fluchtversuche: Technologie zerstören (erfordert Gewalt, funktioniert spieltheoretisch nicht) oder Technologie zur Überwachung von Technologie einsetzen (Orwells 1984 mit KI-Upgrade). Beide haben gravierende Haken - aber manche Forscher, darunter das Machine Intelligence Research Institute, argumentieren, dass sich KI-Rechencluster ähnlich kontrollieren ließen wie Atomwaffen. Neun Länder besitzen Nuklearwaffen, niemand wurde seit 80 Jahren durch eine getötet.

Das Video trifft einen Nerv, weil es nicht predigt, sondern zeigt. Jedes Szenario hat eine innere Logik - und genau das macht die Sache so unbequem.